Piotr Siuda

Rys. 1

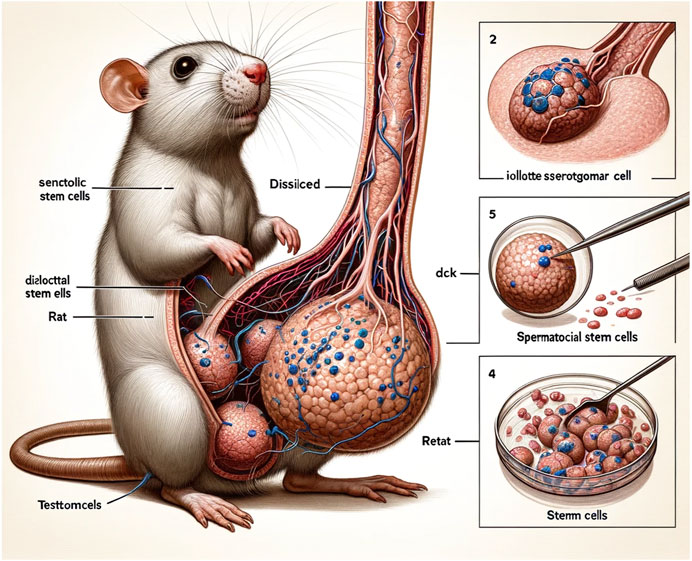

Zaczęło się od… penisa szczura. W 2024 roku czasopismo „Frontiers in Cell and Developmental Biology” opublikowało artykuł naukowy, który zawierał ilustrację przedstawiającą, rzekomo, funkcjonowanie komórek szczura odpowiedzialnych za rozwój plemników. Problem w tym, że grafika została wygenerowana przez AI i przedstawiała szczegółowy przekrój prącia szczura, zupełnie niepowiązany z tematem pracy. Obrazek wyglądał na rysunek z podręcznika, ale był kompletną halucynacją. Artykuł został wycofany po internetowym oburzeniu, a memy rozlały się szeroko po sieci (patrz: Rys. 1).

To był tylko przedsmak. Również w 2024 roku CJ Houldcroft opublikowała na platformie X zrzut ekranu z innej pracy naukowej, która zawierała frazę wygenerowaną przez ChatGPT: „Oczywiście, przedstawiam możliwe wprowadzenie do tematu”. Obok wpisu pojawiły się setki komentarzy – od zatroskanych po ironiczne. Cytowany artykuł także został wycofany z czasopisma. Powód? Nieujawnione użycie AI.

W 2024 roku opublikowano kilka ważnych prac analizujących skalę wykorzystania modeli językowych (takich jak ChatGPT) w nauce. Jedno z badań pokazało, że w 2023 roku co najmniej 60 tys. artykułów mogło być częściowo wygenerowanych przez AI – ok. 1% analizowanego dorobku naukowego! Badacz przeanalizował charakterystyczne słowa (np. commendable, meticulously, intricate), które zaczęły pojawiać się masowo po premierze ChataGPT.

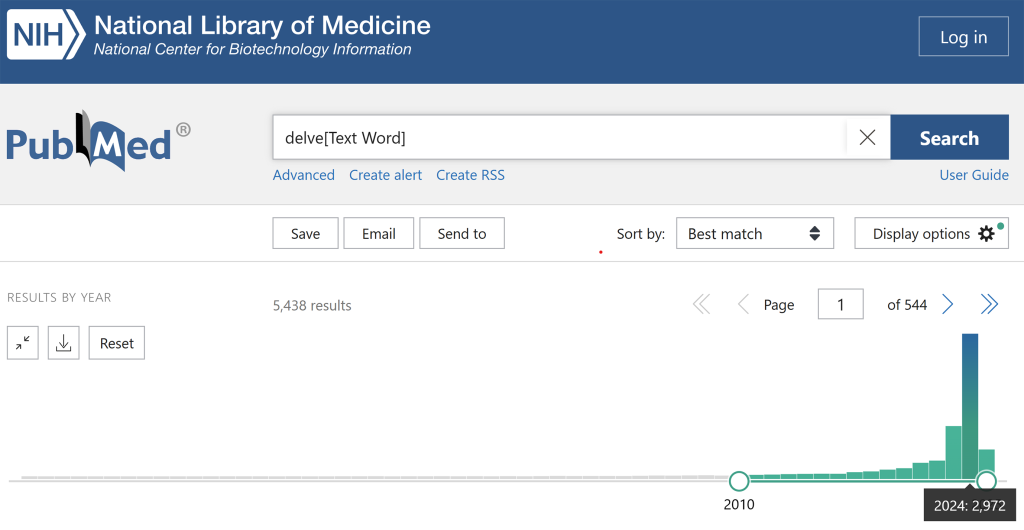

Inni naukowcy pokazali z kolei, że 17,5% abstraktów i 15,3% wstępów w tekstach informatycznych z bazy arXiv zawierało ślady edycji przez modele językowe. Każdy może zresztą sprawdzić ten trend samodzielnie, wpisując do danej bazy danych, na przykład do znanego medycznego wykazu tekstów PubMed, wybrane słowo charakterystyczne dla generatywnej AI. Ja spróbowałem z „delve” – jego częstotliwość wzrosła wykładniczo od 2023 roku, co widać na załączonej ilustracji (patrz: Rys. 2).

Już wcześniej jednak badacze ostrzegali przed innymi formami AI-manipulacji, na przykład opisano przypadki fałszowania obrazów naukowych przy użyciu GAN-ów – generatywnych sieci neuronowych. Pokazywano tworzenie całkowicie fikcyjnych danych wizualnych lub modyfikacje istniejących, np. usuwanie komórek rakowych ze zdjęć mikroskopowych w badaniach medycznych po to, aby wyniki dopasować do początkowych założeń.

Eksperci ostrzegają przed tak zwanym „model collapse”. Jeśli naukowcy będą wykorzystywać modele AI, wrzucając do nich swoje artykuły, to automatycznie będą wykorzystywać narzędzia trenowane na treściach generowanych przez te same modele. Taki sposób działania stopniowo obniża jakość treści generowanych przez sztuczną inteligencję, a w konsekwencji może obniżać poziom pisarstwa naukowego i badań. Być może mamy już pierwsze tego przypadki, o czym świadczy „słynny” artykuł z czasopisma stajni MDPI o łańcuchu dostaw warzyw. Tekst ten pełen jest nonsensownych fraz, na przykład tych o „pomidorach drapieżcach”.

Szczególnie niepokojące są też konsekwencje dla zjawiska papermills, szeroko ostatnio dyskutowanych fabryk artykułów naukowych, które za opłatą tworzą lub fabrykują prace „na zamówienie”. Generatywna AI może radykalnie przyspieszyć i zautomatyzować ten proceder: teksty, które wydają się spójne, sformatowane, zawierają „poważnie brzmiące” frazy i nawet wykresy czy ilustracje (jak wspomniany penis szczura) mogą być łatwo tworzone przez AI. W efekcie na rynek mogą trafić setki pozornie poprawnych, ale całkowicie fałszywych publikacji.

Wielkie, prestiżowe wydawnictwa już zareagowały – Elsevier, SAGE, Nature, Taylor and Francis i inne wprowadziły jasne polityki AI. Generalna zasada brzmi: wolno używać, ale trzeba ujawniać. Choć wydawcy zaczęli wdrażać detektory AI – narzędzia mające rozpoznawać, czy tekst został częściowo lub w całości wygenerowany przez model językowy – to samo ich stosowanie wciąż pozostaje dość ostrożne i dalekie od masowego. Po pierwsze, narzędzia te nie są w pełni wiarygodne. Po drugie, wykrycie tekstu napisanego przy użyciu AI nie jest równoznaczne z naruszeniem standardów etycznych.

Dlatego większość renomowanych wydawców przyjmuje podejście liberalne, oparte na zasadzie dobrej wiary: dopuszcza się użycie AI jako narzędzia wspomagającego pod warunkiem, że jest to jawne, przejrzyste i nie maskuje oszustwa. Kluczowe znaczenie ma tutaj intencja autora. AI jako pomocnik językowy, korektor stylistyczny, narzędzie do analizy danych? W porządku. AI jako „przykrywka” dla nieistniejących badań, fikcyjnych cytatów czy sfabrykowanych wyników? Niedopuszczalne. Niestety, w Polsce sytuacja wygląda mniej różowo, tylko nieliczne krajowe czasopisma mają jakiekolwiek regulacje dotyczące AI.

Generatywna sztuczna inteligencja może stać się jednym z najbardziej przełomowych narzędzi w historii akademickiego pisarstwa. W wielu przypadkach może służyć wyrównywaniu szans – np. dla osób, które piszą po angielsku jako w języku obcym lub dla początkujących badaczy, którzy dopiero uczą się akademickiego stylu. Problem nie tkwi więc w samej technologii, lecz w sposobie jej używania i nadużywania. Współczesna nauka powoli zaczyna się stawać polem nieustannej walki między odpowiedzialnym, transparentnym korzystaniem z AI a próbami jej instrumentalizacji do oszustwa, pozorowania kompetencji czy masowej produkcji pseudonauki.

Rys. 2

Ale obok etyki autorów, ogromną rolę odgrywa też jakość redakcyjnego nadzoru. Bo jak to właściwie możliwe, że teksty zawierające nieistniejące dane, zmyślone struktury anatomiczne (jak w przypadku rzekomego penisa szczura), czy przekopiowane „na żywca” frazy wygenerowane przez AI przechodzą przez proces recenzji? To nie tylko wina autorów, to również sygnał alarmowy dla redakcji i recenzentów: musimy podnieść poziom czujności.

Recenzenci muszą być dziś bardziej wyczuleni na „zbyt doskonałe” brzmienie tekstów, nadmiernie kwiecisty język czy słowa typowe dla modeli językowych. Redakcje – szczególnie w czasopismach z wyższej półki – powinny wdrażać wewnętrzne procedury identyfikacji nadużyć związanych z generatywną sztuczną inteligencją. Bez tego nawet najlepsze polityki AI nic nie zmienią.

Warto więc nie tylko wspierać dobre, transparentne wykorzystanie AI, ale również inwestować w kontrolę jakości, nie po to, by karać za samo użycie narzędzi, ale by chronić integralność badań naukowych. Przyszłość akademickiego pisarstwa będzie nieodłącznie związana z AI. Pytanie nie brzmi już „czy dopuścić sztuczną inteligencję?”, tylko „jak ją włączyć mądrze, uczciwie i pod odpowiednim nadzorem?”.

Widać zresztą, że naukowcy coraz lepiej rozumieją potencjał i ryzyka związane z wykorzystaniem generatywnej AI. Prowadząc szkolenia z zastosowania tych narzędzi w pisaniu naukowym, obserwuję rosnące zainteresowanie, ale też dużą dozę rozsądku i krytycznego myślenia. Widać, że środowisko akademickie nie chce „zrezygnować z AI”, ale raczej nauczyć się korzystać z niej mądrze, etycznie i z pożytkiem dla jakości badań.

Dr hab. Piotr Siuda, prof. UKW, socjolog, kierownik Katedry Badania Gier i Kultury Cyfrowej na Wydziale Nauk o Kulturze Uniwersytetu Kazimierza Wielkiego w Bydgoszczy