Tomasz Ratajczyk

Rys. Sławomir Makal

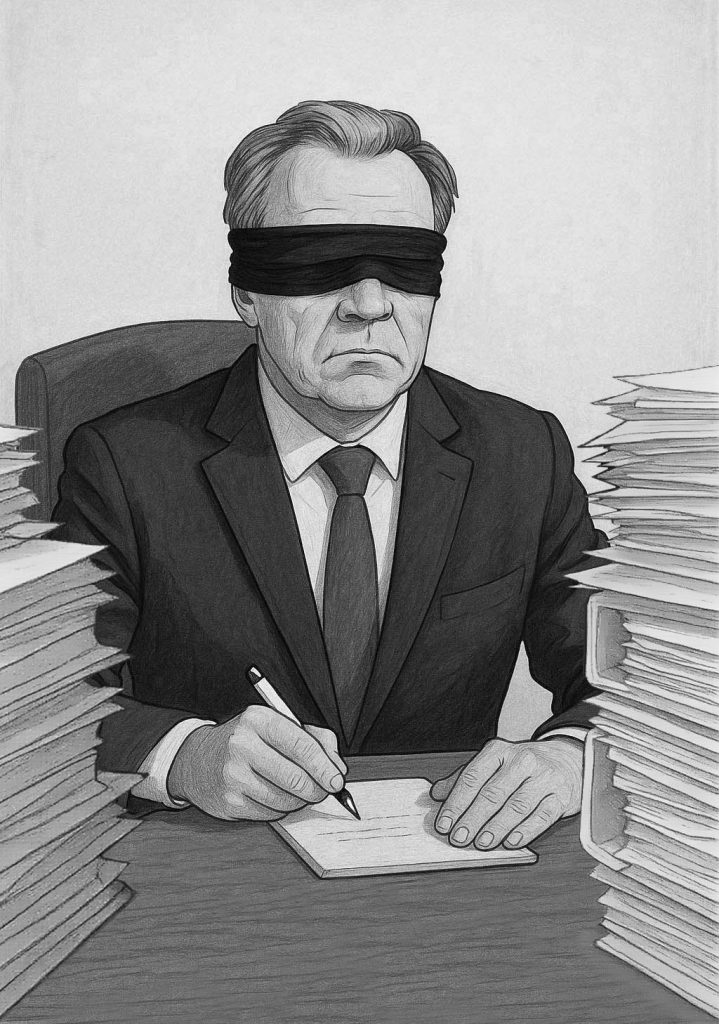

Od lat toczy się dyskusja na temat jakości działania Narodowego Centrum Nauki, w szczególności w kontekście oceny rozpatrywanych wniosków, głównie w programie OPUS, który dysponuje największym budżetem i jest kierowany do wszystkich naukowców, bez względu na etap ich kariery. Najwięcej wątpliwości wzbudza jakość oceny na pierwszym etapie, jako że jest on szczególnie narażony na różnego rodzaju błędy i nierzetelności. Wynika to z faktu, iż to właśnie w tym momencie oceniane są jedynie skrócone opisy wniosków grantowych, a samej oceny dokonują eksperci, którzy nie muszą być specjalistami w tym samym obszarze panelu (i na tym etapie jest to zrozumiałe). Na przykład w panelu ST4 naukowiec zajmujący się elektrochemią może oceniać wniosek ze spektroskopii magnetycznego rezonansu jądrowego i odwrotnie. Dodatkowo ekspert w krótkim czasie musi przeanalizować dużą liczbę takich opisów, co może skutkować powierzchowną bądź nierzetelną oceną.

W świetle ostatnich artykułów opublikowanych na forach akademickich rzeczywiście można mówić o nieprawidłowościach na pierwszym etapie oceny. Zjawisko to zauważył również były przewodniczący Rady Narodowego Centrum Nauki (J. Bujnicki, J. Kuźnicki, Czy Narodowe Centrum Nauki i sztuczna inteligencja są na siebie gotowe?, FA 2/2025).

Oczywiście, skala nierzetelności na tym etapie jest trudna do oszacowania bez szczegółowego wglądu w dane NCN dotyczące liczby odwołań. Dodatkowo warto zauważyć, że wielu wnioskodawców zamiast się odwoływać, co jest procesem długotrwałym i mało skutecznym, pisze nowe wnioski, gdyż te, które zostały odrzucone, nie mogą być składane w kolejnym bezpośrednio następującym konkursie OPUS, lub też czekają na upływ okresu karencji i ponownie składają te same wnioski w następnych konkursach, czyli w przypadku OPUS-a po roku. Nawet jeśli przyjąć, że skala problemu jest niewielka, nie można przejść nad nim do porządku dziennego. Należy podjąć działania mające na celu eliminację zarówno zaniedbań, jak i patologicznych zachowań ekspertów na pierwszym etapie oceny. System oceny wniosków w NCN powinien być zatem nieustannie monitorowany, korygowany i dostosowywany do zmieniających się okoliczności, w szczególności w kontekście coraz powszechniejszego zastosowania sztucznej inteligencji oraz nasilających się negatywnych zjawisk, choćby takich jak tzw. papiernictwo.

Jednym z działań mających na celu poprawę jakości oceny na pierwszym etapie oceny grantów było umiędzynarodowienie panelu ekspertów. W 2019 r. 25% członków panelu stanowili eksperci z zagranicy, podczas gdy w 2024 r. odsetek ten wzrósł do 95% (Mariusz Karwowski, Współpraca z Rosją, sztuczne cytowania, podejrzenia o paper mills… Zajrzeliśmy na listę ekspertów NCN, forumakademickie.pl, 07.05.2025).

Jednak czy ten zabieg poprawił fachowość oceny? Niestety, odpowiedź na to pytanie wydaje się negatywna, o czym pisałem w artykule Rzetelna analiza czy pozory oceny?

Mało tego, można się zastanawiać, czy NCN nie stał się bardziej podatny na poważne patologie toczące współczesną naukę. Przykładowo, pomimo dwustopniowego procesu oceny wniosków, NCN finansował granty przyznane tzw. papiernikom, co zostało opisane w artykule M. Karwowskiego Fabryki artykułów pracują pełną parą (forumakademickie.pl, 08.01.2025).

Twierdzenie, że umiędzynarodowienie paneli wpłynęło na poprawę jakości ocen na pierwszym etapie to mit, co zresztą potwierdza fakt, iż wśród recenzentów na tym etapie nie brakuje ekspertów o wątpliwych kompetencjach, o czym wyżej wspominałem. Zatem przejście z jednej skrajności w drugą – od ~100% polskich ekspertów z jednej strony, do ~100% zagranicznych ekspertów z drugiej – nie okazało się panaceum na poprawę jakości oceny wniosków na pierwszym etapie. Jedna z szanowanych polskich instytucji grantowych, jaką jest Fundacja na rzecz Nauki Polskiej, również nie ma całkowicie umiędzynarodowionego zespołu oceniającego. Czy zatem powinniśmy nadal tkwić w przekonaniu, że umiędzynarodowiony panel to jedyne rozwiązanie, a wpadki niestety się zdarzają i nic nie da się z tym zrobić? A może jednak NCN powinien podjąć działania, które będą skutecznie przeciwdziałały obniżeniu jakości procesu recenzji i oceny? A jeśli tak, to jakie?

Może warto przyjrzeć się systemowi pośredniemu, który nie miał nigdy szansy systemowego zaistnienia. Być może lepszym rozwiązaniem byłby system, w którym połowa ekspertów pochodziłoby z Polski, a druga połowa z zagranicy. Myślę, że za powyższym rozwiązaniem przemawia kilka argumentów. Na przykład, polscy naukowcy mieliby okazję zobaczyć, jak pracują ich koledzy recenzenci z zagranicy. Ci pierwsi mogliby także korygować niezrozumienia polskiego systemu przez kolegów spoza Polski, np. wyjaśniać, dlaczego dany adiunkt chciałby dodatków w wysokości 500 euro miesięcznie, pomimo iż jest zatrudniony na etacie. Być może recenzja naukowca z Rzeszowa (w którym NCN ostatnio gościł przy okazji Dni Narodowego Centrum Nauki), Lublina czy Warszawy, choć być może nie będzie pisana w luksusowym hotelu w Arabii Saudyjskiej, okaże się lepsza od tej napisanej przez wybitnego zagranicznego eksperta, jakim jest profesor Rafael Luque Alvarez de Sotomayor, który publikuje nowy tekst naukowy co 37 godzin?

Wreszcie, skoro tak trudno znaleźć zagranicznych ekspertów, to jeśli będzie ich o połowę mniej, to może uda się wybrać tych lepszych, niekoniecznie takich, których opisano w wyżej przytoczonym artykule. Myślę również, że w systemie 50/50 istnieje mniejsze prawdopodobieństwo tworzenia się różnego typu wzajemnie wspierających się układów niż w przypadku 100% polskich badaczy. Oczywiście koordynatorzy muszą zadbać o to, aby nie było konfliktu interesów między polskim ekspertem oceniającym wniosek a jego polskim kolegą, który ten wniosek składał. Może warto też zadać pytanie, czy zagraniczny ekspert, będący specjalistą w dziedzinie spektroskopii optycznej i oceniający wniosek z zakresu elektrochemii, posiada rzeczywiście wyższe kwalifikacje niż polski specjalista z tej samej dziedziny?

Wreszcie, całkowite wyłączenie polskich badaczy z procesu recenzyjnego wyklucza młodych naukowców. Wyklucza tzw. pokolenie NCN – młodych, dynamicznych, wyróżniających się naukowców, z których wielu lobbowało za zwiększeniem finansowania NCN. Dlaczego w proces recenzji wniosków nie można włączyć również młodych badaczy, którzy prawdopodobnie wykazaliby się większym zaangażowaniem i skrupulatnością w ocenach, co z nawiązką wynagrodziłoby ich mniejsze doświadczenie. Przy okazji pojawiłaby się możliwość weryfikacji ocen pisanych przez ich bardziej doświadczonych kolegów, którzy mogli już popaść w rutynę i mniej im zależy na rzetelnym wywiązaniu się z roli eksperta, mają bowiem szereg innych zajęć i propozycji naukowych. Myślę, że wielu młodych badaczy wyraziłoby chęć uczestnictwa w takim programie nawet pro publico bono, nie oczekując luksusowych hoteli, po to tylko, aby przekonać się, jak działa proces recenzyjny. I byłoby to dla nich z dużo większą korzyścią niż uczestnictwo w warsztatach symulujących panel ekspertów NCN (tzw. mock panel), który należy postrzegać w kategorii paradokumentalnego show.

Inne z ciekawszych rozwiązań zostało zaproponowane przez Profesorów Jacka Kuźnickiego i Janusza Bujnickiego w artykule, w którym zasugerowali oni wykorzystanie sztucznej inteligencji do poprawy jakości oceny wniosków lub do kontroli, czy ekspert nie napisał nieprawdy w raporcie. Realizacja tej propozycji, zakładająca, że oceny wniosków dokonują w stu procentach zagraniczni eksperci, sprawiłaby, że nie byłoby konieczności zmiany tego systemu. Podam tu prosty przykład. W każdym uzasadnieniu znajduje się kilka zdań, w których opisana została przyczyna odrzucenia wniosku. Myślę, że AI mogłaby szybko zweryfikować, czy napisana dwu-, trzyzdaniowa negatywna opinia zgadza się z tym, co zostało zawarte we wniosku. To z kolei pozwoliłoby wyeliminować wiele problemów. Przykładowo, myślę, że AI wyeliminowałaby choćby takie przypadki, w których recenzent twierdzi, że autor grantu chce zatrudnić trzech doktorantów, a we wniosku jest jasno i klarownie napisane, że w grancie przewidziane jest miejsce dla jednego doktoranta.

Przykładowo zadałem pytanie ChatowiGPT dotyczące mojego grantu w celu sprawdzenia, czy recenzent nie myli się w swojej opinii (cała procedura zajęła dosłownie 2 minuty [sic!]). Na pytanie: „Czy na podstawie podanego opisu można stwierdzić, że «The proposal calls for 3 ph.d. students, which appears excessive for the stated problem and proposed experiments»? AI odpowiedziała: „Nie, na podstawie podanego opisu nie można stwierdzić, że «the proposal calls for 3 ph.d. students». W opisie projektu jest wyraźnie napisane: «Their work will be significantly facilitated by 1 PhD and 2 MSc students». Oznacza to, że zespół badawczy planuje zaangażować jednego doktoranta (PhD student) i dwóch magistrantów (MSc students), a nie trzech doktorantów. Zatem stwierdzenie, że propozycja zakłada «3 PhD students» jest faktycznie nieprawdziwe i wynika z błędnej interpretacji tekstu. Gdyby taki komentarz pojawił się np. w recenzji wniosku grantowego, warto byłoby go zakwestionować i zwrócić uwagę na rzeczywisty skład zespołu”.

Jakkolwiek takie rozwiązanie może wydawać się futurystyczne i budzić wiele wątpliwości związanych z prawami autorskimi oraz finansowaniem odpowiednich narzędzi, to prędzej czy później będzie musiało zostać w takiej czy innej formie wdrożone. Tytuł wspomnianego artykułu mógłby zatem brzmieć nie „Czy NCN będzie gotowe na AI?”, ale raczej: „Kiedy będzie na to gotowe?”. W tym kontekście bardzo cieszy decyzja NCN o organizacji panelu dotyczącego sztucznej inteligencji w nauce podczas Dni NCN w Rzeszowie.

Gdy jednak wszystkie rozwiązania zawiodą, można odwołać się do procedury, w której pretensje można mieć już tylko do sił wyższych, czyli wybrać drogę losowania, co jest na przykład dyskutowane w artykule Funding lotteries for research grant allocation: An extended taxonomy and evaluation of their fairness.

Wydaje się zatem, że istnieje całe spektrum możliwości usprawnienia systemu recenzji na pierwszym etapie oceny grantów, a całkowite umiędzynarodowienie tego etapu oceny w największej organizacji grantowej w Polsce nie jest jedyną drogą lub powinno być usprawnione np. przez AI. Być może w mniejszych państwach taka internacjonalizacja jest koniecznością. Jednak w naszym przypadku warto rozważyć również inne rozwiązania. Jednak to, czy dyskusja – w końcu coś zupełnie naturalnego w środowisku akademickim – zostanie podjęta, zależy przede wszystkim od władz Narodowego Centrum Nauki, a nie od tego, co napisze skromny adiunkt.

Dr inż. Tomasz Ratajczyk pracuje w Instytucie Chemii Fizycznej PAN.