Krzysztof Brzechczyn

Rys. Sławomir Makal

Pojęcie modelu w filozofii i metodologii nauki stosowane jest w nader wieloznaczny sposób, a różnice te pogłębiają się, gdy rozpatrzymy odmiany modelowania stosowane w rozmaitych dziedzinach nauk społecznych i humanistycznych. Najogólniej rzecz biorąc, modelem można nazwać pewien uproszczony fragment rzeczywistości. Jednakże konsensus ten się kończy, gdy zaczniemy analizować sposób i przedmiot tegoż upraszczania. Przykładowo wyróżnić można – a wymieniona lista bynajmniej nie jest pełna – modele symulacyjne, idealizacyjne czy ikoniczne. Model symulacyjny, zwany również prototypem, różnić się może od modelowanego obiektu wielkością, lecz zachowując pewne parametry oryginału, może być zamiast niego poddawany badaniom, doświadczeniom lub eksperymentom. Tak pojęte modele wykorzystuje się w produkcji przemysłowej, np. przed wyprodukowaniem samochodu nowej marki przeprowadza się badania na jego prototypie.

Modele idealizacyjne są świadomym uproszczeniem i deformacją bardziej złożonych obiektów w celu wyjaśnienia ich dotychczasowych stanów/zachowań czy sformułowania prognoz. Przykładem konstrukcji takich modeli jest punkt materialny w fizyce, model zrównoważonego rynku w ekonomii czy model w pełni racjonalnego podmiotu stosowany w naukach społecznych. Model ikoniczny jest symboliczną reprezentacją danego zjawiska. Powszechnie używanymi są mapy odwzorowujące określony wycinek powierzchni Ziemi. Wyróżniamy więc mapy fizyczne, polityczne, ekonomiczne, drogowe, turystyczne itp.

Modelowanie w praktyce naukowej może wynikać z różnych źródeł. Stać za nią mogą przekonania ontologiczne zakładające, że zewnętrzna rzeczywistość jest obiektywnie zróżnicowana na istotę i akcydensy, co wymusza poznawanie jej za pośrednictwem modeli. Modelowanie wynikać może z przyczyn epistemologicznych – nauce stawiane są rozmaite cele poznawcze, co wymusza wybór badania jednych aspektów fragmentu rzeczywistości społecznego kosztem pozostałych. Taka selekcja wynikać może również z przyczyn antropologicznych: ograniczona natura władz poznawczych człowieka oraz skończony czas aktywnego życia narzucają pewien wybór zainteresowań badawczych. W naukach stosowanych typ i rodzaj stawianych przez społeczeństwo czy państwo celów badawczych wymusza koncentrację na tych aspektach rzeczywistości przyrodniczej bądź społecznej, które przynoszą wymierne korzyści społeczne, kosztem zaniechania eksplorowania innych jej aspektów. Wreszcie sama społeczna organizacja nauki: podział i wyodrębnienie dyscyplin naukowych oraz konstytuujących je metod badawczych sprawia, że poszczególne dyscypliny nauk społecznych bądź humanistycznych (historia, politologia, socjologia) ex definitione badają określony i w określony sposób wycinek rzeczywistości społecznej.

Ponadto wyróżnić można aksjologiczne źródła modelowania. Zbliżony status do modeli stosowanych w nauce mają utopie społeczne, projekty polityczne, a nawet teksty popkultury. Piosenka Imagine Johna Lennona przedstawia nowy świat społeczny pozbawiony w porównaniu z tym aktualnie istniejącym pewnych cech: własności, religii i państw narodowych. Gdy czynniki te zostaną usunięte z życia społecznego – tak można rekonstruować przesłanie Lennona – zapanuje powszechne braterstwo i dobrobyt. Utwory artystyczne tym się różnią od projektów politycznych, że pozbawione są wymiaru aplikacyjnego – nie wiadomo jak je wprowadzić w praktyce i do jakich doprowadzą skutków. Dzięki temu wizje świata zawarte w utworach artystycznych łatwo odróżnić od naukowych. Gorzej jednak, gdy zawarta utopia społeczna wyrażona jest w języku naukowym i jednocześnie umyka procedurze falsyfikacji.

Ta rozmaitość modeli stosowanych w nauce sprawia, że nie ma jednej metody ich konstruowania. W referowanym tutaj ujęciu inspirowany jestem podejściem idealizacyjnej teorii nauki sformułowanej przez Leszka Nowaka, jednego z założycieli Poznańskiej Szkoły Metodologicznej. Można wyróżnić cztery stadia konstrukcji modelu. W pierwszym stadium badacz, przyjmując określoną perspektywę ontologiczną, odróżnia czynniki, które wpływają na badane zjawisko od tych, które nie wywierają nań wpływu. Następnie na podstawie przyjętej perspektywy teoretycznej określa, jakiego typu czynniki z zakładanej przez niego perspektywy ontologicznej są główne, a jakie uboczne. W trzecim stadium badacz dokonuje hierarchizacji mocy wpływów w obrębie czynników głównych i ubocznych.

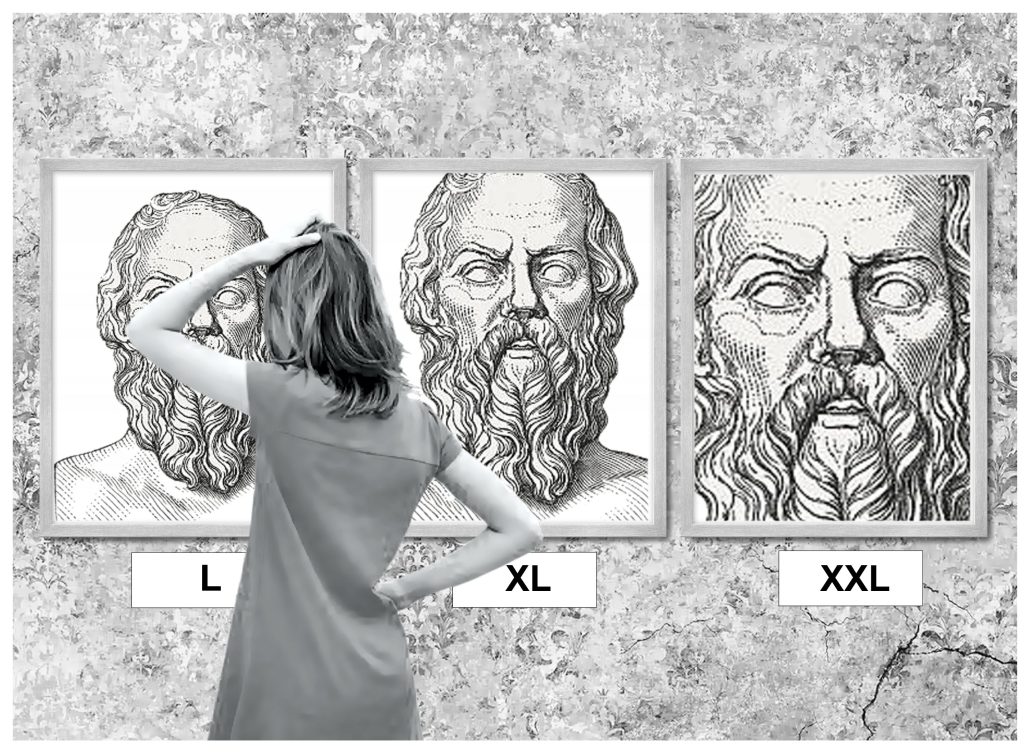

Wreszcie w czwartym stadium badacz formułuje twierdzenie ukazujące zależność badanego zjawiska od jego głównego (głównych) czynnika. Twierdzenie to ma postać okresu warunkowego. W jego poprzedniku występują kontrfaktyczne założenia, na których mocy pomija się wpływ czynników uznanych przez badacza za uboczne, zaś w następniku poszukiwana zależność. Otrzymane twierdzenie idealizacyjne obowiązuje zatem tylko pod określonymi założeniami idealizującymi, i to pod wszystkimi z nich. Z tego powodu budowana metodą modelową teoria naukowa przypomina bardziej karykaturę niż fotografię.

To ostatnie stadium nie występuje w metodzie typowo-idealnej pochodzącej od Maxa Webera. Zasadza się ona na takim konstruowaniu pojęć naukowych, że obecne w nich cechy – w porównaniu z empirycznymi obiektami – występują w maksymalnym bądź minimalnym natężeniu. Typy idealne konfrontuje się z obiektami empirycznymi, które klasyfikuje się na podstawie dystansu (lub bliskości) pomiędzy nimi a danym typem idealnym oraz wyprowadza hipotezy wyjaśniające zachowanie badanych obiektów. Typy idealne pełnią więc heurystyczną rolę w formułowaniu hipotez i budowie teorii. Jeżeli natomiast pewne obiekty empiryczne są zbyt odległe od typu idealnego, wtedy zawęża się jego zakres obowiązywania i tworzy się nowy konstrukt lub tak modyfikuje wyjściowy, aby obejmował wyłączone przypadki.

Zobrazujmy te stwierdzenia krótkim przykładem z historii sowietologii. W latach 50. ubiegłego wieku Zbigniew Brzeziński i Carl Friedrich sformułowali typ idealny społeczeństwa totalitarnego obejmujący sześć powiązanych ze sobą cech. Były to: oficjalna, wszechobejmująca ideologia; kierowana przez dyktatora monopartia; system terrorystycznej kontroli policyjnej obejmujący nie tylko społeczeństwo, lecz i członków partii; monopol kontroli środków społecznej komunikacji, środków przymusu oraz gospodarki. Na podstawie tak skonstruowanego typu idealnego totalitaryzmu autorzy sformułowali tezę o trwałej atomizacji społeczeństwa sowieckiego i niezagrożonego wewnętrznymi protestami panowania Partii.

Tak sformułowany typ idealny totalitaryzmu teoretycznie sterował pracami historycznymi i politologicznymi opisującymi dzieje społeczeństwa rosyjskiego w okresie panowania Stalina. Głównym czynnikiem przekształceń społecznych – przede wszystkim likwidacji prywatnego rolnictwa prowadzącego w latach 30. ubiegłego wieku do klęski głodu – była ideologia marksistowska, a przeprowadzane czystki partyjne w KPZR, propagandowo przedstawiane jako eliminacja wrogów klasowych i szkodników, miały być rezultatem realizacji ideologicznej wizji, której ofiarami padały niejednokrotnie przypadkowe osoby. Fundamentalna rola w tym procesie przypadać miała Stalinowi, który w pełni kontrolował proces totalitaryzacji społeczeństwa sowieckiego.

Jednakże powstania w Gułagu oraz protesty 1956 roku w Polsce i na Węgrzech podważyły tezę o trwałej atomizacji totalitarnych społeczeństw typu sowieckiego. W zachodniej sowietologii doprowadziło to do dwojakiej reakcji. Jedną z nich było ograniczenie zakresu obowiązywania typu idealnego społeczeństwa totalitarnego, który miał dotyczyć okresu stalinizmu. Ponadto wprowadzono typ idealny społeczeństwa posttotalitarnego (w nauce światowej dokonał tego Juan J. Linz, zaś w Polsce zwolennikiem stosowania typu idealnego posttotalitaryzmu był Andrzej Walicki). Uwzględnia się w nim wpływ rytualizacji ideologii oraz narastający pluralizm ośrodków władzy. W takim systemie społecznym posttotalitarna władza nie jest już w stanie nieustannie mobilizować społeczeństwa, lecz swoje panowanie opiera na pasywności społeczeństwa, które może zajmować się swoim życiem prywatnym.

Całkowite odrzucenie założeń teoretycznych typu idealnego totalitaryzmu nastąpiło w paradygmacie rewizjonistycznym sformułowanym w amerykańskiej sowietologii w latach 70. ubiegłego wieku. Wedle Sheili Fitzpatrick, głównej eksponentki tego podejścia, stalinowskie czystki miały być sposobem wymiany wykształconych jeszcze przed rokiem 1917 kadr fachowców zatrudnionych w administracji i gospodarce. Ta wymiana była spowodowana koniecznością przeprowadzenia przyśpieszonej modernizacji i industrializacji agrarnego społeczeństwa rosyjskiego. Rola Stalina w tym procesie miała być marginalna, gdyż musiał się dostosowywać do układu sił między partyjnymi koteriami i frakcjami. Same zaś czystki podlegały oddolnym naciskom i nieformalnym negocjacjom, a na ich uzasadnienie wpływała mentalność wywodzącego się z klasy chłopskiej aparatu partyjnego, w której obecne było myślenie spiskowe.

Modele teoretyczne, które mając status paradygmatu, są często nieuświadamiane przez badaczy, sterują ich dalszymi krokami badawczymi: typem wykorzystywanych źródeł, stawianym im pytaniom czy konstrukcją narracji historycznej. Np. zwolennicy modelu totalitarnego wykorzystywali głównie oficjalne dokumenty partyjne i państwowe, zaś rewizjonistycznego – źródła (np. pamiętniki, listy do redakcji czasopism) zawierające informacje o nieformalnych praktykach społecznych. Za tym szła również budowa odmiennych narracji historycznych, np. przypisywanie centralnej roli Stalinowi lub opisywanie postępowania dyktatora koniecznością dostosowania się do układu sił w Biurze Politycznym KPZR.

Zgodnie ze znanym powiedzeniem Hegla, „jeżeli teoria nie zgadza się z faktami, to tym gorzej dla faktów”. Dictum to oznaczać ma myśliciela, który nie zważając na empiryczne fakty i kontrprzykłady, jest dogmatycznie przekonany o prawdziwości swojego punktu widzenia. Tymczasem pewna doza dogmatyzmu jest jednak w nauce nieodzowna. Niewiele wspólnego z praktyką naukową ma bowiem Popperowski antydogmatyzm, wedle którego naukowiec formułuje oryginalną hipotezę rozwiązującą problem naukowy, a potem, jedynie pod wpływem krytycznej dyskusji naukowej, jest gotowy ze swojego pomysłu teoretycznego zrezygnować. Po pierwsze, trudno wpaść na pomysł oryginalnej hipotezy/teorii, a gdy się takową już sformułuje, to z reguły przez całe życie naukowe jej się broni. Bliżej praktyki naukowej jest Lakatosowska propozycja ograniczonego dogmatyzmu. Wedle niej naukowcy na mocy metodologicznej decyzji oddzielają niepoddający się modyfikacjom, twardy rdzeń programu badawczego od wskazujących jak ów program rozwijać heurystyk pozytywnych i negatywnych. Tutaj jednak wyodrębnienie twardego rdzenia jest kwestią konwencji.

Tymczasem w idealizacyjnej teorii nauki podział na tworzący rdzeń modelu teoretycznego zbiór czynników głównych i modyfikujący ich działanie zbiór czynników ubocznych ma charakter ontologiczny. W przywoływanym ujęciu przyjmowana jest zasada racjonalnego dogmatyzmu oparta na trzech dyrektywach. Pierwszą z nich jest zakaz reifikacji prawa idealizacyjnego zabraniający bezpośredniego odnoszenia twierdzenia idealizacyjnego do faktów empirycznych. Twierdzenie ma status hipotezy, dopóki nie przeprowadzi się serii konkretyzacji polegających na stopniowym uchylaniu założeń idealizujących i modyfikacji wyjściowej zależności idealizacyjnej. Ukazuje się w ten sposób, jak badane zjawisko zależy nie tylko od czynników głównych, ale i od ubocznych. Konkretyzacja taka przebiega w określonym porządku. Najpierw uchyla się założenia idealizujące dotyczące tego czynnika ubocznego, który wywiera największy wpływ na badane zjawisko. W praktyce badawczej nigdy nie przeprowadza się konkretyzacji ostatecznej, w trakcie której wszystkie założenia upraszczające twierdzenia idealizacyjnego zostają zniesione. Zwykle po przeprowadzeniu szeregu konkretyzacji wpływ pozostałych, mniej ważnych czynników ubocznych określa się w sposób przybliżony, lecz nieprzekraczający przyjętego w danej nauce i w danym czasie progu dokładności.

Drugą dyrektywą jest odróżnianie faktów pozornie przeczących modelowej teorii od faktów rzeczywiście ją negujących. Jeżeli badacz napotyka fakty przeczące wysuwanej przez siebie teorii idealizacyjnej, to najpierw zakłada, że są to fakty niezgodne z nią prima facie. Stara się zatem jej twierdzenia konkretyzować, uwzględniając wpływ czynników ubocznych. Dopiero wtedy, kiedy fakty nadal przeczą każdej z przeprowadzonych konkretyzacji, następuje odrzucenie danego twierdzenia. I wreszcie ostatnią dyrektywą jest zakaz idealizacji ad hoc polegający na wprowadzaniu dodatkowych założeń jedynie po to, aby uniknąć zarzutów krytycznych bez prób przeprowadzenia konkretyzacji.

Są to – przyznajmy nader subtelne – mechanizmy broniące naukę przed dogmatyzacją. Są skuteczne, gdy dana dziedzina nauki jest wieloparadygmatyczna a badania prowadzone są we względnej izolacji od ich innych dziedzin życia społecznego. Gdy jednak dana teoria staje się zarazem ideologią państwową – tak jak to było z marksizmem w Związku Sowieckim – lub jest sprzężona z ekonomicznymi interesami np. globalnych koncernów, te mechanizmy obronne okazują się są zbyt słabe, a rdzeń teorii jest niemodyfikowalny.

W literaturze przedmiotu poświęconej modelowaniu często dostrzega się pokrewieństwo pomiędzy modelem a karykaturą i fikcją literacką. Przykładowo, Nancy Cartwright zauważa podobieństwo pomiędzy bajką i morałem oraz modelem i prawem naukowym. Według niej bajki przekształcają abstrakcyjne zasady etyczne w konkretne zasady postępowania. Bajka jest odpowiednikiem modelu zawierającego prawo naukowe. W bajce odpowiednikiem prawa naukowego jest płynący z niej morał. Ponadto stereotypizacja i antropomorfizacja występujących w bajce postaci zwiększać ma perswazyjność przekazu: lis odznacza się chytrością, osioł jest uparty, a sowa mądra.

Niektóre przynajmniej z występujących tu intuicji można wyrazić w aparaturze pojęciowej idealizacyjnej teorii nauki, w której wyróżnia się dwie mocne i dwie słabe procedury deformacyjne. Załóżmy, że mamy wyjściowy obiekt O wyposażony w pewien zbiór własności występujących w określonym natężeniu. W wyniku transcendentalizacji obiekt O’ zostaje wyposażony w pewne dodatkowe własności, których wyjściowy obiekt O nie ma. Odwrotną procedurą jest redukcja, polegająca na pozbawieniu wyjściowego obiektu pewnych własności. Natomiast w wyniku zastosowania potencjalizacji dodatniej własności obiektu O’ występują w natężeniu wyższym niż własności wyjściowego obiektu O. Procedura potencjalizacji ujemnej prowadzi do uzyskania obiektu, którego własności występują w natężeniu niższym od natężeń własności obiektu wyjściowego.

Na wytwory intelektualne budowane w różnych dziedzinach kultury można spojrzeć jako na rezultat stosowania złożonych procedur deformacyjnych. Idealizacja w nauce ma być połączeniem redukcji i potencjalizacji ujemnej: badacz eliminuje czynniki niewpływające na badane przez niego zjawisko, a tym, które wywierają wpływ uboczny, przypisuje w twierdzeniu idealizacyjnym zerowe natężenia. Absolutyzacja/mitologizacja stosowana w teologii i myśleniu religijnym jest złożeniem transcendentalizacji i potencjalizacji dodatniej: teolog, tworząc konstrukt Boga, wyposaża go we własności waloryzowane w danej tradycji religijnej pozytywnie (dobroć, wszechmoc, wszechwiedza) w maksymalnym natężeniu. Fikcjonalizacja stosowana w literaturze i sztuce jest złożeniem redukcji i potencjalizacji dodatniej: konstruowane postaci literackie wyposażone są w cechy i własności o takich natężeniach, które nie występują w świecie empirycznym, o pewnych zaś cechach bohaterów literackich (np. kto był dziadkiem Boryny z Chłopów Władysława Reymonta) nie sposób nic orzec. Również stereotypy opierają się na procedurze fikcjonalizacji: z zestawu cech stereotypizowanej postaci pewne się pomija, a te, które są dlań w jakiś sposób charakterystyczne, występują w maksymalnym natężeniu.

Pomimo wspomnianych podobieństw wytwory kulturowe różnią się zasadniczo od modeli naukowych. Modele i teorie mogą się różnić stopniem sformalizowania, podlegają konkretyzacji, empirycznemu sprawdzaniu i falsyfikacji oraz – jeżeli są formułowane w naukach stosowanych – mogą być podstawą praktyk społecznych zmierzających do przekształcania i zmieniania świata. Takich oczekiwań nie formułuje się wobec wytworów innych dziedzin kultury, dlatego ich rolą społeczną jest ćwiczenie wyobraźni poprzez deformowanie w rozmaitych kierunkach aktualnego świata.

Prof. dr hab. Krzysztof Brzechczyn, kierownik Pracowni Epistemologii i Kognitywistyki, Wydział Filozoficzny Uniwersytetu im. Adama Mickiewicza w Poznaniu