Paweł Polak

Rys. Sławomir Makal

Pogranicza nauki, obszary, w których metoda naukowa traci swą oczywistość, działa na granicach aktualnych możliwości i staje się wręcz kontrowersyjna, to pasjonujący temat dla historyka i filozofa nauki. Wspomniane problemy mają bowiem często źródło w filozoficznych podstawach nauki. Stąd refleksja filozoficzna jest sprawdzoną drogą do zrozumienia tych trudności. Nawet jeśli sama nie daje zwykle bezpośrednich rozwiązań dla reformatorów, to pozwala przynajmniej zrozumieć szkodliwość proponowanych „kuracji”. W obliczu wyzwań stojących przed nauką to pomoc, której nie można odrzucić.

Jaki użytek mogą przynieść nauce mity? Wszak metoda naukowa, zwłaszcza w przyrodoznawstwie, jest bezprecedensowym dążeniem do ścisłości i klarowności. Cóż więc nauka może zyskać dzięki mitom? Interesującej odpowiedzi udzielił wybitny filozof pochodzenia austriackiego Karl R. Popper (1902-1994). Uważał, że teorie naukowe mogą mieć u swych początków dowolne konstatacje. Może to być nawet mit. Mit jest jednak z zasady niesprawdzalny, bliżej mu raczej do domeny wiary. Musi zatem zostać poddany racjonalnemu badaniu. Wówczas na tej inspiracji można zbudować testowalną teorię. Jednocześnie kończy się rola mitu.

Mitologizacja nauki to proces idący w przeciwną stronę. Pokusa myślenia mitologicznego nieustannie zagraża nauce, bo ludzie potrzebują mitów. Nauka jest więc poddana ciągłym napięciom między wyborem racjonalnych wyjaśnień zamiast wyjaśnień mitologicznych. W każdej chwili mierzymy się z dylematami starożytnych filozofów greckich. I jak wówczas, tak samo i dziś – wybór racjonalności jest wyborem o charakterze moralnym, dotyczy moralności myślenia.

W tym miejscu należy postawić pytanie: dlaczego nie sformułować odpowiedniego kryterium, które pozwoli jasno oddzielić naukę od nienauki, tak jak w ewangelicznym przesłaniu wartościowe ziarno było oddzielane od plew? Poszukiwanie kryterium demarkacji było historycznie jednym z ważniejszych obszarów filozofii nauki. Dziś, pod wpływem znanej krytyki Larrego Laudana (1941-), trudno uwierzyć w możliwość przeprowadzenia prostej, niekwestionowalnej, z góry zdefiniowanej linii podziału. Nie da się jednak wskazać ogólnego, ponadczasowego algorytmu orzekania o nienaukowości. Nie znaczy to, że nie potrafimy w konkretnym przypadku ocenić wartości danego dokonania naukowego – specjaliści z danej tematyki powinni być w stanie tego dokonać, bo inaczej znaczyłoby, że nie posiadają podstawowej zdolności rozumienia znaczenia badań, którymi się zajmują.

Oczywiście w ocenie wartości badań zawsze możliwe są pomyłki, ale częste doświadczenia uczestników postępowań naukowych wskazują, że to nie one deformują oceny. Najczęściej są to względy pozamerytoryczne. I w ten sposób ujawnia się bodajże najszkodliwsza mitologia nauki tworzona przez samych uczonych.

Jeśli unikanie negatywnych ocen jest szkodliwą mitologizacją, to jak patrzeć na zgoła analogiczną sytuację na poziomie teorii naukowych? Pytanie postawione w śródtytule nabiera w tym kontekście jeszcze większego ciężaru. Słuszne wydaje się Popperowskie nastawienie żądające od teorii tego, aby były wystawione na możliwość obalenia w świetle obserwacji lub eksperymentów. W przypadku ujawnionej niezgodności logicznie rzecz biorąc teoria jako zdanie ogólne okazuje się fałszywa. Naiwnie zatem można oczekiwać logicznej decyzji o odrzuceniu teorii. Tak samo konsekwentnej jak odrzucenie tego, co niesprawdzalne i błędne w mitach.

Dlaczego zatem nie postępujemy według jasnego, logicznego schematu? Najważniejszym uzasadnieniem jest to, że teoria jest intelektualnym narzędziem do wyjaśniania i przewidywania. Jeśli nie mamy w zanadrzu innej, lepszej teorii, to nawet odkrywając ograniczenia posiadanej teorii, nie wyrzucimy jej. Przecież bardziej racjonalne jest posługiwać się niedoskonałą teorią (która coś jednak dobrze wyjaśnia) niż żadną. I nawet dziś używamy w praktyce niektórych teorii, choć wiemy, że nie są w sensie ścisłym prawdziwe. Tak jest choćby z mechaniką newtonowską, która pozwala projektować zdecydowaną większość współczesnych urządzeń mechanicznych. Po ogólniejszą mechanikę relatywistyczną sięgamy stosunkowo rzadko, w sytuacjach raczej wyjątkowych. Prostota, skuteczność i wystarczająca dokładność przewidywań teorii Newtona okazuje się praktycznie wystarczająca. I to wystarczy, by z niej nie rezygnować.

Oczywiście czymś innym jest podtrzymywanie przy życiu teorii tylko decyzją naukowca, który nie może pogodzić się z odrzuceniem jej w świetle faktów. Zasadniczo sytuacja wydaje się klarowna – uczony powinien bardziej słuchać faktów (obserwacje, doświadczenia) niż własnych subiektywnych ocen. Dlaczego zatem nauka błądziła i będzie nieraz błądzić w przyszłości? To cena, jaką musimy zapłacić za to, żeby w ogóle dało się formułować nowe teorie. Gdyby Kopernik słuchał rad metodologów, zapewne nigdy nie sformułowałby ani swej teorii, ani nie zapoczątkował nowej nauki. Wszak działał on w zasadzie wbrew faktom. Był świadom braku kluczowej obserwacji zjawiska paralaksy mogącego potwierdzić ruch Ziemi wokół Słońca. Wiemy, że problem ten Kopernik rozwiązał w genialny sposób, postulując hipotezę, że Wszechświat jest tak wielki, iż nie można go obserwacyjnie zmierzyć. Oczywiście hipotezy tej nie mógł udowodnić. Dla metodologa wyglądała ona na najgorszą z możliwych – to hipoteza postulowana ad hoc po to tylko, aby bronić innej hipotezy. Geniusz Kopernika polegał na tym, że odgadł bardzo dobre wyjaśnienie, choć wszystko pozostawało w sferze hipotez i domysłów. Gdyby ściśle trzymać się zaleceń metodologów, zapewne wciąż używalibyśmy fizyki Arystotelesa, a komputery byłyby uważane za fantasmagorie spekulatywnych umysłów.

Służyć może różnym celom, często politycznym. Niekiedy w niepewnych czasach potrzebujemy punktu oparcia, potrzebujemy niepodważalnej ekspertyzy. Nauka, choć daje niekiedy niezwykle precyzyjne przewidywania, nie może zagwarantować, że wyjaśni idealnie wszystko w przyszłości. Oznaczałoby to bowiem, że już dziś mamy pełną wiedzę o rzeczywistości. A do tego wciąż przecież nam daleko.

Niestety nauka nie zawsze daje tak proste odpowiedzi, jak byśmy tego oczekiwali. Zastępowanie ostrożnych wypowiedzi badaczy stanowczymi trawestacjami nie służy samej nauce. W ten sposób tworzymy bowiem coś, co przypomina naukę, ale nią nie jest. Pseudonauka wyrasta bowiem często z cnotliwych intencji.

Filozofia demitologizuje pewność i apodyktyczność nauki, ale wskazuje też, że nie znamy lepszej metody odkrywania prawdy o przyrodzie. Nie możemy przy tym zapominać, że nauka tworzona jest przez ludzi. Co prawda dziewiętnastowieczny scjentyzm kreował naukowców na swoistych herosów, którzy potrafią przezwyciężyć swe ludzkie ograniczenia, wznieść się ponad nie i zupełnie bezstronnie, obiektywnie poznawać fakty. Okazało się jednak, że oczekiwania te bliższe były opowieściom barona Münhausena, który twierdził, że wyciągnął się z bagna za włosy, niż realnym możliwościom ludzi. Dzisiejszy kult ekspertów i ekspertyz karmi się zresztą podobnymi nadziejami. Pseudonauka wyrasta jakże często z cnotliwych intencji i oczekiwań złączonych z marną filozofią.

Naukowiec pozostaje człowiekiem i wszystkie ludzkie ograniczenia, przeświadczenia czy uprzedzenia zabiera ze sobą do laboratorium. Przekonań nie da się zostawić w szatni wraz z płaszczem, jak chciał dziewiętnastowieczny pozytywista Claude Bernard (1813-1878). To niewykonalne. Gdyby nawet się to udało, naukowiec byłby bezsilny – nie mógłby sformułować najmniejszej obserwacji. Każda obserwacja zakłada (jawnie bądź nie) jakiś punkt widzenia.

Akceptując typowo ludzkie uwarunkowania naukowca, musimy wziąć pod uwagę to, że podlega on skomplikowanemu zespołowi uwarunkowań. Wymieńmy tu choćby uwarunkowania psychologiczne, używany język, dostępną wiedzę tła, opinie społeczności, a nawet swoiste mody naukowe. Oczywiście czynniki te można jeszcze długo wyliczać. Filozofowie nazywają je zbiorczo czynnikami eksternalistycznymi w nauce.

Jednym z najgroźniejszych czynników eksternalistycznych jest ideologia. To jej wpływy chcieli usunąć Bernard i wielu innych. Siła nacisków ideologicznych nie pozwala na działanie naturalnych procesów krytyki naukowej. Ideologizacja jest znaną przyczyną długofalowych i głębokich spustoszeń na gruncie nauki. Dość wspomnieć tutaj o biologii sowieckiej, której twarzą był Trofim Łysenko. Wyrządzone szkody spowodowały zapaść sowieckiej biologii, z której podnosiła się długie dziesięciolecia. To jednak nie tylko domena historii. Dziś mamy do czynienia z różnymi ideologiami, a najnowszą jest tzw. kultura unieważnienia (cancel culture) wprowadzająca niebezpieczne mechanizmy autocenzury w środowisku naukowym.

Niszczycielski wpływ ideologii szerzy się w okresach osłabienia etosu uczonych. Pełni on bowiem rolę systemu obronnego nauki. Nawet na tak zgrubny szkic rażące byłoby jednak sprowadzenie problemów współczesnej nauki tylko do dychotomii: prawdziwi naukowcy kultywujący tradycyjny etos versus ich zideologizowani, wykorzenieni koledzy. Wzrost znaczenia czynników eksternalistycznych (zwłaszcza socjologicznych) w nauce ma przecież źródło również w obiektywnych procesach zachodzących w strukturze samej nauki i w strukturze komunikacji naukowej. Co więcej, wygląda na to, że procesy są obecnie nieuniknione, choć w Polsce nieco opóźnione w stosunku do procesów w przodujących krajach. Źródłem problemów, które mam na myśli, jest to, że nauka bezpowrotnie utraciła elitarny charakter. Zmiana ta wynika z logiki komunikacji i rozwoju wiedzy naukowej. Żyjemy bowiem w epoce Big Science obwieszczonej przez Dereka J. de Solla Price’a (1922-1983).

Koncepcja Wielkiej Nauki przekroczyła już sześćdziesiąt lat, choć wciąż nie do końca uświadamiamy sobie jej konsekwencje. De Solla Price zwrócił uwagę na to, że typowy rozwój nauki prowadzi do eksponencjalnego wzrostu różnorodnych wskaźników opisujących ilościowy rozwój nauki (np. liczba publikacji, liczba uczonych etc.). Ten bardzo szybki wzrost powodowany jest dynamiką wzrostu wiedzy w społecznych sieciach uczonych. Zwiększona ilość informacji tworzy nowe zagadnienia i wymaga jeszcze większych sił do jej przetworzenia, co powoduje naturalny (relatywnie bardzo szybki) wzrost tych sieci. Sukcesy nauki i techniki pozwalały przez dłuższy czas zachowywać bardzo szybkie tempo wzrostu. W ten sposób nauka musiała utracić elitarny charakter, a włączając w swój obręb osoby niepodzielające w pełni zastanego etosu, przyspieszyła tylko ewolucję aksjologii działalności naukowej. Bez odwołania do naukometrii nie da się więc zrozumieć dzisiejszych problemów z nauką.

Naukometria kojarzy się w Polsce generalnie co najmniej źle. Wśród humanistów ma czarną sławę, zapewne gorszą nawet niż w przypadku drugiego intelektualnego „dziecka” Francisa Galtona (1822-1911), czyli eugeniki. Jest to zapewne wynik użycia uproszczonych narzędzi naukometrycznych w aktualnej polityce naukowej. Tematyka nadchodzącej ewaluacji jest na tyle zaogniona w wielu środowiskach, że lepiej się w nią tu nie wikłać, aby nie stracić z oczu innych czynników, które często umykają środowiskowym dyskusjom.

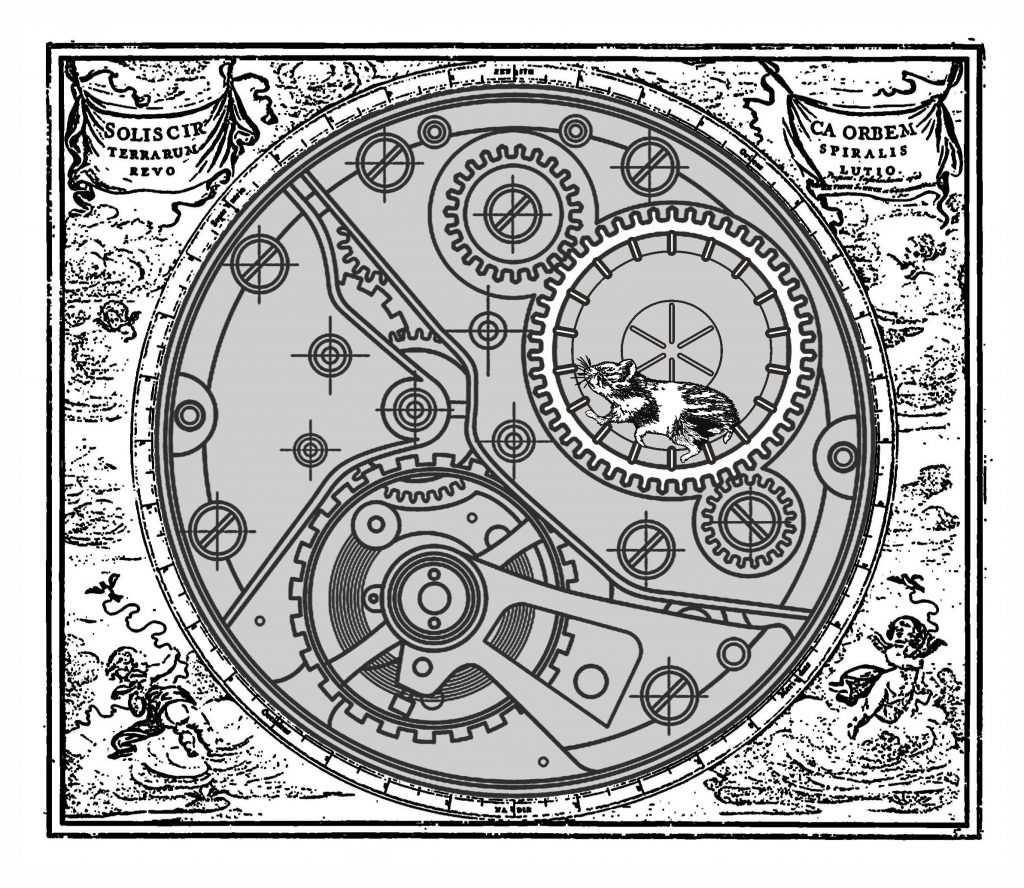

Naukometryczne narzędzia oceny mają niewątpliwe zalety z punktu widzenia ewaluacji działalności naukowej. Pozwalają na szybką i sprawną ocenę, uwzględniając stosunkowo łatwo parametryzowalne cechy, odzwierciedlające pewne istotne cechy procesów komunikacji naukowej. Dają przy tym miłe poczucie obiektywizacji procesu oceniania. Sęk w tym, że funkcja parametryzująca dane naukometryczne musi z konieczności zawierać elementy arbitralności (albo w ogóle może być arbitralną konwencją), taki też charakter mieć będzie cała ocena. Współcześnie uważa się, że cena płacona za możliwość sprawnej i w miarę „obiektywnej” oceny jest do przyjęcia (niektórzy nawet uważają, że to uczciwa cena). Sęk w tym, że tak zbudowana polityka naukowa ma poważne konsekwencje. Najczęściej wspomina się o tzw. wyścigu szczurów, o zjawiskach typu „salami publishing” (tworzenie artykułów z możliwe najmniejszym udziałem istotnie nowych treści dla zwiększenia liczby prac) czy o generalnym obniżeniu poziomu prac i stopnia ich dojrzałości. Nie negując tych problemów, chciałbym zwrócić uwagę na jeszcze jeden, rzadziej podnoszony w dyskusjach. Należy oczekiwać, że preferowanie ocen naukometrycznych będzie prowadzić do powstawania działalności, której celem nie jest ani pogłębianie wiedzy, ani jej opracowanie. Kręgi cytowań (powstające na różnych poziomach), nieuczciwe praktyki związane z uznawaniem autorstwa itp. są objawami procesów toczących naukę w skali globalnej. Aby się o tym przekonać, wystarczy spojrzeć na dyskusje prowadzone u największych wydawców czasopism naukowych. Wyspecjalizowane kręgi cytowań będą mieć tendencje do ograniczania głosów spoza nich, przy okazji osłabiając stopniowo mechanizmy samokontroli naukowej. Szczególnie niebezpieczne jest to w naukach humanistycznych i społecznych, które podatne są na przekształcanie się wówczas w działalność pseudonaukową. Przy odpowiednio dobranym kręgu cytowań i swoiście pojętej solidarności uczestników wskaźniki brane do oceny mogą być bardzo dobre (przynosząc pochwały rektorów, dziekanów, dyrektorów etc.), a faktyczna działalność może się coraz bardziej alienować od rzeczywistości. Pseudonauka nie jest zatem odgrodzona jakąś jedną linią demarkacyjną od bezpiecznego obszaru nauki. Uwarunkowania naukometryczne sprzyjają powstawaniu działalności pseudonaukowej w pozornie „porządnych” miejscach. Ostatnim zabezpieczeniem znów okazuje się etos uczonego (czyli sfera indywidualnych decyzji). Dziś, w dobie osłabienia etosu, preferowanie wskaźników naukometrycznych szczególnie silnie powinno prowadzić do erodowania nauki.

Żywotne zagrożenia czyhają zatem głównie „wewnątrz” nauki. Jeśli powyższa diagnoza jest trafna, to dokładanie kolejnych wskaźników naukometrycznych nie przyniesie istotnej poprawy sytuacji. Ten fundamentalny problem rozwoju nauki doskonale ujął w połowie lat trzydziestych XX w. wybitny polski filozof i historyk filozofii ks. Konstanty Michalski (1879-1947). Komentując ówczesne nieszczęsne pomysły reformatorskie, określił je sporem między mechanizmem a organizmem w myśleniu o nauce. Naukę widział Michalski jako organiczną strukturę, która w swym bogactwie przypomina raczej złożony organizm niż maszynę. Podkreślał jednak, że w zarządzaniu nauką traktuje się ją jako układ, który można regulować mechanicznie (dziś powiedzielibyśmy: za pomocą algorytmów). Prowadzi to do nieuniknionej nieadekwatności proponowanych rozwiązań, a wszelkie propozycje naprawy sytuacji przez modyfikację mechanizmów są nieskuteczne z powodu tego błędnego założenia.

Przeszło osiemdziesiąt lat później słowa Michalskiego są zaskakująco aktualne. To pokazuje, jak trudno nauczyć się czegoś na doświadczeniach historycznych. Pokazuje też, że nauka okazała się jednak mimo wszystko wyjątkowo odporna jako całość. To daje pewną nadzieję na przyszłość, choć wiadomo, że wnioskowanie indukcyjne, na jakim oparta jest ta nadzieja, jest wnioskowaniem co do zasady zawodnym.

Dr hab. Paweł Polak, prof. UPJPII, filozof przyrody, nauki, informatyki, Wydział Filozoficzny Uniwersytetu Papieskiego Jana Pawła II w Krakowie, redaktor naczelny czasopisma „Zagadnienia Filozoficzne w Nauce”