Jacek Szoltysek

Rys. Sławomir Makal

Gdy czterdzieści lat temu zaczynałem przygodę życiową w systemie nauki, mój szef – wówczas jeszcze docent z habilitacją – narzekał na niestabilny system wymogów, jakie należy spełnić, by awansować w nauce. Wtedy właśnie zmieniono wymogi i dzięki temu pozwolono mi szybko się doktoryzować, bez oczekiwania na „odpowiedni wiek” w ówczesnym instytucie, gdyż sprzyjało to panu docentowi. Od tego czasu regularnie pojawiały się zmiany wymagań, a ja napisałem kilka książek, kilkadziesiąt artykułów w pracach zwartych, kilkaset artykułów w czasopismach naukowych, do tego mnóstwo artykułów popularyzujących moją dyscyplinę (współczynniki cytowań plasują mnie w czołówce polskich logistyków, zatem nie piszę tego artykułu w obronie status quo, lecz w trosce o innych pracowników nauki i sens ich pracy). Czy jednak zawsze korzystamy na zmianach i czy te zmiany są na korzyść nauki?

Naukowcem jest osoba prowadząca działalność naukową i ma to szczęście, że może zawodowo zajmować się swoją pasją. To osoba wolna w zakresie wyborów naukowych, uczciwa oraz niestawiająca sobie ograniczeń innych niż etyczne w pracy badawczej. To osoba, która świadomie wybiera sposoby postępowania badawczego, by odpowiadać na zadawane sobie oraz środowisku naukowemu pytania związane z tym, czego jeszcze nie wiemy, a co ma istotne znaczenie dla, jak to uważał Karl Popper, lepszego wyjaśnienia tego, czego nie znamy lub znamy „nie do końca”. Można też za Johnem Watkinsem uznać, że celem naszego działania powinno być dążenie do spełnienia wymogu możliwej prawdziwości wraz z wymogami wzrostu głębi oraz zakresu akceptowalnych teorii czy też poszukiwanie prawdy lub może jej odkrywanie. O tym, jak fascynująca, a zarazem różnorodna jest działalność naukowa, wiodą dyskusję naukowcy z Uniwersytetu Jagiellońskiego na łamach wydanej w 2016 roku pracy Z naukowcami o nauce. Dla kogo nauka nie jest pasją, jest on osobą w gruncie rzeczy nieszczęśliwą, bo poddaną presji otoczenia, które oczekuje spektakularnych efektów pracy w postaci wysoko punktowanych artykułów naukowych.

Uprawiając zawód naukowca, jesteśmy zobligowani do tego, by dzielić się osiągnięciami z innymi naukowcami, a być może także pozostałymi czytelnikami, którzy zechcą zapoznać się z naszymi pracami. Pisanie artykułów, rozpraw seminaryjnych czy książek, jak również aktywne uczestnictwo w konferencjach naukowych, to nie tylko obowiązkowe składniki brane pod uwagę przy pokonywaniu kolejnych szczebli kariery akademickiej (uzyskiwanie wyższych stopni naukowych i – jako ukoronowanie – tytułu naukowego), ale też jest to element pracy wielu spośród Czytelników – pracowników naukowych (naukowo–dydaktycznych) uczelni, instytutów naukowo–badawczych i innych. Ważność publikacji dla naukowców świetnie opisuje fraza publish or perish (publikuj albo giń). Problemem trudniejszym do rozstrzygnięcia jest to, jaka forma publikowania powinna być obierana z punktu widzenia skuteczności prezentacji swoich poglądów, wyników badań, dyskutowania o zakresie otwierania nowych pól badawczych itd. Równie istotne jest pytanie o częstotliwość publikowania, jak również miejsca plasowania prac. Wreszcie problemem, przed którym staje każdy naukowiec, jest presja otoczenia instytucjonalnego, oczekującego od pracy naukowej jej użyteczności, to jest możliwości monetyzowania wyników pracy, jak również nadążania za dość dynamicznie zmieniającymi się regułami oceny zarówno samych pracowników naukowych, jak i jednostek ich zatrudniających.

Odpowiedź na zarysowane pytania dotyczące formy, częstotliwości, miejsca publikowania związana jest również z tym, czy całą naukę postrzegamy jednakowo, czy też uznajemy, że podział na dyscypliny naukowe ma sens również w kontekście zróżnicowanego oczekiwania i oceniania. To właśnie wszelkiego rodzaju wskaźniki bibliometryczne są podstawą zdobywania grantów, wspinania się po szczeblach kariery i w końcu sukcesu naukowego. I właśnie dlatego problemy publikacji naukowych negatywnie wpływają na całą naukę. Czy faktycznie fizycy, medycy, astronomowie mają być oceniani według tych samych kryteriów co językoznawcy, historycy, antropologowie, ekonomiści? Czy możemy również oczekiwać od wszystkich stosowania jednej metodologii badań, oceniania wszystkich według IF czy współczynników cytowań? Czy zainteresowanie ośrodków i naukowców zagranicznych osiągnięciami polskich językoznawców, historyków jest takie samo jak polskich medyków czy astronomów? Jeżeli odpowiedź na to pytanie jest negatywna, co podpowiada logika myślenia, to dlaczego dla wszystkich w Polsce stosujemy jedną zasadę oceniania dorobku naukowego?

Astronomowie mają cytowania na poziomie kilkudziesięciu tysięcy, medycy – kilkuset tysięcy, antropolodzy – kilku tysięcy. Spoglądając na cytowania pracowników Uniwersytetu Jagiellońskiego w Krakowie (11 lipca 2021 r. – podaję górne granice cytowań) mamy rozrzut od ponad 24 tys. w przypadku nauk medycznych, do kilkuset – jak w przypadku językoznawców (trzech profesorów: 2071, 186, 142). Przykład wskazuje na to, że liczba cytowań to nie tylko funkcja czasu – kto dłużej funkcjonuje w zawodzie, ma statystycznie większe prawdopodobieństwo „nazbierania” cytowań – nie tylko związek ze stanowiskiem, funkcją, ale również z istotnością badanych problemów czy zjawisk, ich popularnością w nurcie dyskusji (np. kwestie Covid, pandemii, modnych trendów w zarządzaniu), kolektywnością powstawania prac (prace samodzielne, kilkuosobowe czy kilkunastoosobowe), jak również zasięgu (w ramach jednej dyscypliny, interdyscyplinarne, z jednego ośrodka, z wielu ośrodków, krajowe, międzynarodowe), finansowania (w ramach środków uczelnianych, w ramach projektów finansowanych ze źródeł zewnętrznych). To po pierwsze, po drugie zaś szanse na wysoko punktowane publikacje również są zdecydowanie różne – inne dla medyków, fizyków, inne dla językoznawców. Zwracam na to uwagę między innymi dlatego, że oczekiwania instytucji krajowych w zakresie publikowania w określonych wydawnictwach są stawiane jednakowo wobec wszystkich.

A przecież nie wszystkie działania mające charakter naukowy znajdują zainteresowanie wśród jednakowo dużej kohorty naukowców, w tym – na całym świecie. Oddzielnym elementem decyzyjnym jest wybór pomiędzy opublikowaniem wyników prac naukowych w postaci książki (monografii naukowej), rozdziału w monografii czy też artykułu. Książkę napisać znacznie trudniej niż artykuł, a przetrwa ona znacznie dłużej niż forma krótsza, jaką jest artykuł. Książkę możemy adresować do odbiorcy krajowego bądź też do szerszego zakresu odbiorców, wówczas powinniśmy ją napisać w języku obcym. Podobnie ma się rzecz z artykułem – można opublikować go w wydawnictwie krajowym bądź zagranicznym. Wybór miejsca publikowania, wydawnictwa, zależny jest od tego, jak jest ono wyceniane przez ministra nauki.

Oczekiwanie od każdego pracownika naukowego wysokiej produktywności jest nierealistyczne. Marek Kwiek w artykule Kim są najbardziej produktywni polscy naukowcy? Produktywność badacza w niezróżnicowanym i niekonkurencyjnym z systemie nauki („Nauka i Szkolnictwo Wyższe”, nr 1-2 (53-54)/2019) zauważa, powołując się na zagranicznych badaczy, że większa część pracy akademickiej wykonywana jest przez stosunkowo niewielką liczbę naukowców, że niezależnie od sposobu pomiaru istnieje ogromna nierówność produktywności badawczej naukowców oraz że nierówność była i na zawsze pozostanie nieodłącznym elementem nauki. Nie jest to zresztą nowe spostrzeżenie, dlatego że asymetryczny rozkład wyników pracy naukowej odkryty był przez Lotkę w 1926 r., zaś czterdzieści lat później potwierdzony przez Price’a. Okazuje się, że około 6% publikujących naukowców wytwarza połowę wszystkich publikacji.

Istnieje tak zwany efekt Mateusza, dotyczący systemu nauki: niewielka liczba naukowców produkuje większość prac, przyciąga ogromne ilości cytowań, zajmuje prestiżowe stanowiska akademickie i odpowiada za kształtowanie tożsamości dyscyplin akademickich. Już w latach sześćdziesiątych ubiegłego wieku Robert K. Merton zauważył, że instytucja nauki rozwinęła skomplikowany system alokacji nagród i przyznawania ich tym, którzy w rozmaity sposób spełniają jej normy. Niezależnie jednak od teorii („iskry bożej”, akumulacji czy teorii maksymalizacji korzyści), która może opisywać indywidualną produktywność badawczą, należy stwierdzić, że zróżnicowanie tejże, opisane przez efekt Mateusza, jest wystarczającą przesłanką ku temu, by uznać, że oczekiwanie od każdego pracownika naukowego podobnego poziomu produktywności jest utopią.

Jednak oczekiwania aparatu instytucjonalnego polskiej nauki, jak się zdaje, ignorują przytoczone wyżej fakty. Zasady obecnie obowiązującej ewaluacji, nazywanej „sercem Konstytucji dla Nauki”, prowadzone są w ramach dyscyplin. W tym zakresie unikniemy porównywania ze sobą wysiłków naukowych reprezentantów różnych dyscyplin. To logiczne podejście, eliminujące nieporozumienia w zakresie nieuzasadnionego porównywania parametrycznej wyceny prac naukowych powstających w zdecydowanie różnych dyscyplinach. Ewaluacja została nazwana „uczciwą”, ponieważ do oceny brane będą pod uwagę osiągnięcia wszystkich pracowników prowadzących działalność naukową w ewaluowanej dyscyplinie. Mało tego, nowy model ewaluacji wprowadza limit osiągnięć, jaki jeden pracownik może zgłosić do ewaluacji. I tu zaczynają się poważne problemy.

Model ewaluacji absolutnie ignoruje znany i przedstawiony powyżej fakt, że jedynie garstka pracowników nauki ową naukę tworzy. Tak było, jest i zapewne będzie, nie zmieni tego oczekiwanie aparatu instytucjonalnego nauki w Polsce. Ograniczanie liczby publikacji uznawanych przez każdego pracownika za wiodące osiągnięcia w okresie czterech lat powoduje, że władze jednostek ewoluowanych będą skłonne do inwestowania jedynie w takie przedsięwzięcia, w rezultacie których pojawiają się publikacje w wysoko punktowanych czasopismach naukowych, będą ograniczać liczbę powstających książek oraz rozdziałów w monografiach. Opublikowanie artykułu w czasopiśmie z tak zwanej „listy” gwarantuje pracownikowi, oraz jednostce zatrudniającej pracownika, otrzymanie stosownej liczby punktów. Przestaje się zatem opłacać: publikowanie w krajowych czasopismach, których punktacja jest niekiedy kilkukrotnie niższa od „wiodących” czasopism; publikowanie w języku polskim; powoływanie się na źródła opublikowane wcześniej w języku polskim. Zamiast wykazywać się (w dobrym znaczeniu) niezależnością sądów, zindywidualizowanym podejściem metodologicznym, trzeba dostosować się do ściśle określonych wymogów metodologicznych danego czasopisma (np. wyłącznie dedukcja wraz z „właściwym” aparatem statystycznym), do sposobu prezentowania treści, do określonego kręgu źródeł literatury, tracąc nieco ze sztuki prowadzenia narracji naukowej na rzecz rzemiosła badawczego.

Ilu pracowników naukowych jest w stanie dostosować się do tych wymogów? Ilu będzie pod przymusem podejmować (nieudane z reguły) próby publikowania we wskazanych wydawnictwach? Ilu badaczy, mimo wykrycia czegoś ciekawego, nie zdoła swoich wyników opublikować? Ile uda się opublikować prac interdyscyplinarnych (na pograniczu dyscyplin)? Czy faktycznie, poza pogorszeniem komfortu pracy sporej rzeszy pracowników naukowych, spodziewamy się przyśpieszonego rozwoju nauki i szybkiego awansu Polski jako awangardy naukowej?

Tadeusz Kotarbiński ponad 100 lat temu (w 1913 roku) w Szkicach praktycznych zwracał uwagę na to, że „w nauce przymus zachodzi pod względem uzasadnienia twierdzeń, usystematyzowania, doprowadzenia do formy adekwatnej, ze względu na przyjęcie ich w skład nauki, jako wytworu, rezultatu działań umysłowych”. Tu pełna zgoda – przymus uczciwego prowadzenia pracy naukowej, prezentowania przemyślanych pomysłów, koncepcji, jak również wyników przeprowadzonych badań, jest warunkiem prawdziwego postępu w nauce. Natomiast przymuszanie pracowników naukowych do publikowania w sytuacji, w której brak dobrych pomysłów, badań, jak również, gdy szanse na opublikowanie są mizerne, nie ma większego sensu. Nie ma też sensu naukowego ograniczanie publikacji jedynie do zakresu opisanego przez wymogi wydawnictw „z listy”.

Stanęliśmy przed przymusem publikowania na listach filadelfijskich po to, by „zwiększyć poziom i rozpoznawalność polskiej nauki”, by móc konkurować z naszymi zachodnimi kolegami. Dlatego zaczynamy pisać według schematów, w języku angielskim, odwołując się do wcześniejszych prac wyłącznie publikowanych w języku angielskim, do kręgu autorów, którzy w danym czasopiśmie „z listy” wcześniej publikowali. Spełnienie takich wymogów zwiększa szanse opublikowania artykułu i otrzymania pożądanych punktów. Innym, nie mniej ważnym elementem są zasoby finansowe, jakimi dysponujemy. Ciekawe spostrzeżenia na ten temat poczynił Nikolay Zolotarev (https://habr.com/ru/post/512104/ dostęp 12.07.2021); posłużę się tu nimi, deklarując pełną zgodność. Teraz ten, kto publikuje artykuł, czyli badacz, płaci za niego (w zależności od czasopisma) od 1.500 do 5.700 dolarów. Ważne, aby zrozumieć, że jest to tylko zapłata za publikację. Pieniądze z uczelni lub grantów przeznaczane są na badania, a czasopismo dostaje gotową treść za darmo. Najciekawsze jest to, że na końcu płaci ten sam co poprzednio (instytut, czyli najczęściej państwo), by mieć dostęp do opublikowanego artykułu. Niestety nie zawsze jakość opublikowanych artykułów jest wystarczająco dobra. Co ciekawe, to właśnie w tych najlepszych czasopismach bardzo często publikowane są artykuły z niedostatecznie szczegółowymi metodami, nie działają linki do źródeł, nie ma kodu, a w bazach brakuje najważniejszych plików. Sama struktura artykułów i procesu publikacji prowadzi do niskiej powtarzalności – jeśli nie wiadomo, co zrobili autorzy, nie możesz tego zreplikować.

Ale jeszcze większą rolę odgrywają dwa inne fakty. Zasada „publikuj albo giń” zmusza naukowców do poszukiwania najświeższych wyników i publikowania ich tak szybko, jak to możliwe. W ten sposób wygrywają ci, którzy piszą dużo prac, a nie ci, którzy prowadzą wysokiej jakości badania. Presja na zdobywanie grantów prowadzi do tego, że bardziej opłaca się publikować częściej, nawet jeśli wyników nie da się później powtórzyć. To już nie jest ważne – artykuł został opublikowany. W niektórych przypadkach może to również prowadzić do oszustw: zarówno drobnych manipulacji za pomocą ilustracji (takich jak można znaleźć na Retraction Watch), jak i fałszowania wyników całych artykułów. I nie mniej ważny fakt: nikt nie jest zainteresowany powtarzaniem cudzych eksperymentów. Bardzo trudno opublikować taką pracę i prawie niemożliwe jest uzyskanie na nią grantu. Każdy chce nowych badań. Czasopismom szczególnie opłaca się publikować artykuły, które uzyskają jak najwięcej cytowań. A powtórzenie znanych wyników wzbudzi znacznie mniejsze zainteresowanie. Co ciekawe, powielanie cudzych badań jest trudne do opublikowania bez względu na to, czy wyniki poprzedniego artykułu zostały potwierdzone, czy obalone. Zdarzają się też sytuacje działań nieuczciwych: wstrzymywanie nadesłanych materiałów, by inny zespół podobne bądź identyczne badania mógł opublikować jako pierwszy. Donoszą o tym sfrustrowani autorzy w sieciach społecznościowych, np. grupa Reviewer 2 Must Be Stopped! na Facebooku.

To nie wszystkie problemy. Dominująca część dorobku polskich naukowców w obszarze nauk społecznych publikowana była i jest w języku polskim, co eliminuje ją jako materiały źródłowe z publikacji w czasopismach z listy filadelfijskiej, zatem w kolejnych cyklach rozwoju nauki odsyła ten dorobek do lamusa. Przepada nasz dorobek naukowy, polska myśl intelektualna. W cytowanych już w tym artykule Szkicach praktycznych Tadeusz Kotarbiński zauważył: „W interesie postępu, wbrew hasłu konserwatywnemu, dobrze robi, jeżeli komunikuje innym – jako wchodzące w skład obecnego stadium rezultatów pracy naukowej, do zbudowania systemu dążącej – nieuzasadnione, nieusystematyzowane jeszcze pomysły, jeżeli tylko dopatruje się w nich, w porównaniu z wyznawanymi obecnie w danej sferze dociekań, choćby źdźbła zmiany na lepsze (licząc w tym i nową podnietę na innych)”. To zachęta, by nieoszlifowane jeszcze pomysły, jeśli tkwi w nich potencjał rozwojowy, publikować dla dobra kolektywnego rozwoju nauki. Takie prace nie mają szansy ukazać się w tych czasopismach.

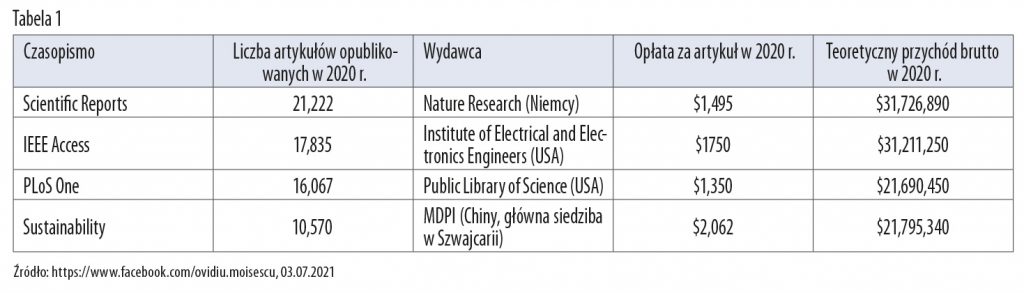

Spójrzmy wreszcie na dane zawarte w tabeli. Pokazują one ogromne liczby publikacji, jak również potężne przychody wydawnictw. Czy możliwe jest utrzymanie w takich warunkach wysokiego poziomu merytorycznego? Czy w takim natłoku pojawiających się publikacji prace naszych autorów będą widoczne? Czy może działania wymienionych wydawców nie są nakierowane raczej na wyniki finansowe, a nie na dbały dobór najwyższej jakości tekstów naukowych?

W swojej karierze zawodowej doświadczyłem już kilku zmian w zakresie oceny dorobku naukowego. Były oceny oparte na liczbie publikacji, ich strukturze, udziale publikacji w językach obcych, liczbie cytowań, współczynnikach cytowań, IF. Teraz kolekcjonujemy punkty za publikacje w czasopismach. Obecny system próbuje rugować z pola publikacyjnego prace w języku polskim, nie docenia książek, promuje system oceny pracowników na podstawie zmieniających się zbyt często parametrów, niepowiązanych jednakowoż z indywidualną wartością dorobku, lecz z mierzalnymi charakterystykami wydawnictw. Ten system powoduje wyprowadzanie z Polski potężnych środków finansowych z przeznaczeniem na opłatę publikacji, uszczuplając fundusze jednostek przeznaczone na badania, wcale nie poprawiając pozycji polskiej nauki na świecie. Ta pozycja nie poprawi się dzięki dużej liczbie publikacji zagranicznych, a poprzez lepsze finansowanie badań, skuteczniejszą dystrybucję środków na badania oraz upowszechnianie współpracy między ośrodkami zarówno krajowymi, jak i zagranicznymi.

Zaczynają się dyskusje nad zasadnością podobnych jak u nas systemów oceny efektywności naukowej (S. Fuller, Must academic evaluation be so citation data driven?, „University World News”, 28.09.2018). 15 czerwca 2021 r. w „Nature” ukazał się artykuł o tym, że powoli uniwersytety zachodnie zaczynają odchodzić od IF jako wyznacznika oceny wartości pracowników naukowych (Ch. Woolston, University drops impact factor, „Nature”, Vol. 595). Chińczycy wybrali swoją ścieżkę ewaluacji akademickiej w kierunku nacisku na rozwój bardziej zróżnicowanych wskaźników, a zwłaszcza tworzenia nowych standardów opartych na chińskim kontekście i wartościach akademickich oraz krajowych wymaganiach. Nowe systemy oceny powinny zachęcać naukowców do przyczyniania się do tworzenia narodu silnego w dziedzinie edukacji, nauki i technologii, a nie tylko służyć społeczności międzynarodowej, międzynarodowym czasopismom indeksowanym lub zagranicznym wydawcom (F. Huang, China is choosing its own path on academic evolution, „University World News”, 26.02.2020).

Może należy pomyśleć o tym, że działalność naukowa to nie rzemiosło, w którym łatwo można skonstruować coś raz do roku i opublikować zgodnie ze wzorcem, lecz że jest to sztuka, wytwór intelektu, wymagający niekiedy dłuższego czasu, namysłu, dyskusji oraz udostępnienia w języku oraz formie, które będą sprzyjały rozpowszechnianiu i inicjowaniu dalszych badań? Może czas, by przemyśleć ponownie sposoby ewaluacji i przywrócić tradycyjne formy prezentowania wyników pracy naukowej?

Prof. dr hab. inż. Jacek Szołtysek, kierownik Katedry Logistyki Społecznej, Uniwersytet Ekonomiczny w Katowicach