Łukasz Wawrowski

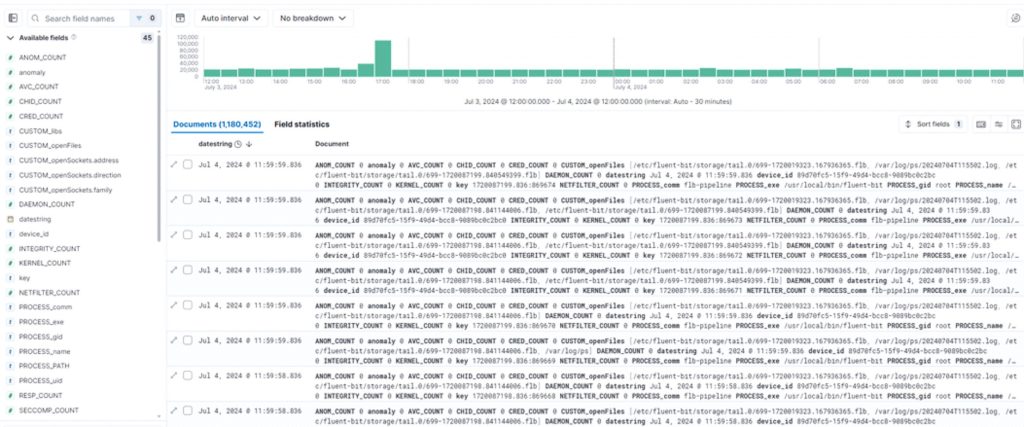

Rys. Przykładowe zmienne niezależne (po lewej) i zmieniający się w trakcie 24 godzin wolumen napływających danych (górny wykres).

Postęp technologiczny sprawia, że coraz chętniej otaczamy się przedmiotami, które mają stały dostęp do internetu. Nikogo już nie dziwią pralki czy lodówki, które żądają hasła do Wi-Fi, a podłączanie robota sprzątającego czy fotowoltaiki do domowej sieci jest czymś naturalnym. Wszystkie te urządzenia mają w założeniu ułatwić nam codzienne funkcjonowanie i z reguły ich awaria nie powinna negatywnie wpływać na nasze życie. Wymienione sprzęty to te, z którymi stykamy się najczęściej, jednak ogólnie rzecz ujmując, stanowią one jedynie wierzchołek góry lodowej. Urządzenia internetu rzeczy (Internet of Things – IoT) odpowiadają także za dużo poważniejsze zadania, aniżeli czystość podłogi w salonie. Można tutaj wskazać różne urządzenia medyczne, inteligentne liczniki, systemy bezpieczeństwa, czujniki w urządzeniach przemysłowych czy strategiczne systemy zarządzania ruchem drogowym i kolejowym. Obecnie słowo „inteligentny” można łączyć niemal z każdym przedmiotem codziennego użytku, więc inteligentny zegarek czy zamek do drzwi nie jest niczym nadzwyczajnym.

W ostatnich latach sprzęty elektroniczne znacznie potaniały (głównie za sprawą krajów azjatyckich), więc tworzenie „smart” domu nie wiąże się już z degradacją domowego budżetu. Czy powinniśmy się zatem otoczyć takimi gadżetami i powierzyć im dostęp do większości elementów naszego codziennego życia? Rzeczywistość pokazuje, że często nie wiemy, co nasze urządzenia robią za naszymi plecami. W 2020 roku wyciekły zdjęcia wykonywane przez roboty sprzątające, co wywołało dyskusję dotyczą przestrzegania prywatności przez sprzęty IoT. Początek roku 2024 przyniósł ciekawą historię pralki, która przesyłała dziennie prawie 4GB danych. W tym przypadku winne było najpewniej oprogramowanie routera, które błędnie raportowało dane. Wykryte w podobnym czasie podatności na urządzeniach Bosch mogły spowodować realne zagrożenie osób korzystających z tego sprzętu. Zaprezentowane przykłady pokazują, że urządzenia internetu rzeczy, mimo niewątpliwych zalet, mogą także stanowić zagrożenie dla naszej prywatności oraz bezpieczeństwa.

Bezpieczeństwo sieciowe kojarzy nam się najczęściej z zapewnieniem kontroli nad możliwością nieuprawnionego dostępu do szeroko rozumianych zasobów. Jest dla nas intuicyjne, że używamy trudnych do złamania haseł w bankowości elektronicznej czy kont społecznościowych. Obawiamy się bowiem tego, że ktoś nas „okradnie” w sensie finansowym lub wyśle naszym znajomym wiadomości, których byśmy sobie nie życzyli. Oczywiście przytoczone przykłady są bardzo naiwne, bowiem zagadnienie bezpieczeństwa sieciowego jest o wiele szersze. Jednym z cenniejszych zasobów bywa bowiem w dzisiejszych czasach nie tyle pieniądz, ile informacja. Dlatego wypracowuje się coraz mocniejsze narzędzia kontroli dostępu do zasobów w celu minimalizowania możliwości wycieku informacji poufnych. Minimalizowania, gdyż nie można wykluczyć, że na skutek niedoskonałości stosowanych rozwiązań, zwiększającej się wiedzy atakujących czy też w końcu w wyniku błędu/nieroztropności ze strony człowieka dojdzie do sytuacji rażąco naruszającej bezpieczeństwo np. danych. Nie dalej jak w minionych tygodniach słyszeliśmy doniesienia medialne o wycieku danych osobowych klientów dużego sklepu stacjonarnego i internetowego. Co prawda według oświadczenia rozsyłanego elektronicznie dane dotyczące loginu i hasła nie były przedmiotem wycieku, jednak już same informacje kontaktowe, historia zamówień czy reklamacji mogą posłużyć do próby podszywania się pod oryginalnego właściciela danych w celu rozsyłania fałszywych wiadomości, np. o charakterze windykacyjnym.

Zapewnienie rzetelnej kontroli dostępu do zasobów jest zatem jednym z kluczowych elementów bezpieczeństwa sieciowego. Do tego celu stosuje się – nierzadko wielostopniową – autoryzację użytkownika, monitorowanie logowań z nowych, nieznanych wcześniej urządzeń czy też wręcz uniemożliwia się logowanie spoza wydzielonej do tego celu sieci. Jednak pomimo tego nie można wykluczyć jednej z dwóch sytuacji: dostęp do zasobu zostanie złamany przez osobę nieuprawnioną albo osoba mająca dostęp do zasobu zacznie korzystać z niego w sposób niedozwolony. Należy zatem oprócz kontroli dostępu dostarczyć mechanizmów pozwalających na wychwycenie sytuacji nietypowej z punktu widzenia zabezpieczanego zasobu. W monitorowaniu ruchu sieciowego – i nie tylko – do tego celu wykorzystuje się m.in. metody wykrywania anomalii. Czym jest anomalia? Niczym innym jak po prostu odstępstwem od typowego zachowania obserwowanego obiektu. Posiadając odpowiednio dużą próbkę opisującą zachowanie typowe, można zatem wykryć, że obiekt przestaje się zachowywać w sposób typowy. Jednak nie można wykluczyć, że przyczyna zmiany sposobu zachowania się obiektu nie ma źródeł związanych z sytuacją niebezpieczną. Przykładem anomalii, która nie jest sytuacją niebezpieczną, będzie opisana w kolejnej części sytuacja z nagłym skokiem zużycia wody.

Opisany szerzej w kolejnym punkcie projekt ma w nazwie wyrażenie „analiza behawioralna”. Czym jest taka analiza w rozumieniu zespołu realizującego projekt SPINET? Sam behawioryzm to dziedzina nauki skupiająca się na badaniu zachowania ludzi i zwierząt. Nie wchodząc w filozoficzne detale, powiem, że dziedzina ta w ogólności koncentruje się na badaniu czynników wpływających na zachowanie żywego obiektu. W naukach technicznych często stosuje się analogiczne podejście do urządzeń, maszyn, procesów. W oparciu o informacje na temat stanu środowiska, w jakim znajduje się obiekt, jak również na podstawie bieżącej i historycznej informacji o jego właściwościach, dokonuje się oceny stanu diagnostycznego rozważanego obiektu. Dysponując taką wiedzą, można nie tylko określać bieżący stan diagnostyczny (np. w trzystopniowej skali „jest dobrze” / „stan się pogarsza” / „stan niepożądany”), lecz także dokonywać predykcji, kiedy może nastąpić zmiana stanu. Ponadto, obserwując momenty zmiany stanu, można próbować doszukiwać się przyczyn tych zmian, np. jakie zmiany środowiska wokół mogły stanowić przesłankę pogorszenia się stanu diagnostycznego. Innym aspektem związanym z obserwowaniem zachowania obiektu jest samo wykrywanie sytuacji, gdy stan obiektu odbiega od tego, co uznajemy za normalność czy też typowość. Pytaniem wtórnym staje się „dlaczego?”, wobec pierwotnego „czy jest normalnie?”. W sytuacji uznania bieżącego stanu za nietypowy, odpowiedź na pytanie „dlaczego?” może zarówno wyjaśnić racjonalne przyczyny, jak i z drugiej strony może dostarczyć konkluzji, że to otoczenie obiektu zmieniło się znacząco, na przykład w wyniku naruszenia jego bezpieczeństwa. Dobrym przykładem wykorzystania analizy behawioralnej są modele oceniające sposób korzystania z aplikacji bankowych na podstawie danych biometrycznych i wykrywające działania oszustów. Niedawno wielu z nas żyło emocjami związanymi z wydarzeniami sportowymi. Pewnie niejedne służby dostarczające wodę do naszych mieszkań zaobserwowały znaczący wzrost zużycia w przerwach rozgrywek. Prawie z pewnością dobowy rozkład zużycia wody zaczął zatem odbiegać od typowego, co mogło zostać uznane za anomalię. Jednak przyczyna jej wystąpienia daleka była od związanej z niebezpieczeństwem czy awarią.

Pracownicy Łukasiewicz-EMAG mają doświadczenie w pracach związanych zarówno z diagnostyką urządzeń (np. przenośniki chodnikowe, kombajny ścianowe, suwnice), jak też z monitorowaniem bezpieczeństwa w ruchu sieciowym właśnie dzięki wykrywaniu nietypowych cech tego ruchu. Na tej podstawie oraz w oparciu o wiedzę dziedzinową partnerów, z którymi realizowano projekt, uznano za interesujący z punktu naukowego i pożądany biznesowo projekt, w którym obiektem stają się urządzenia klasy IoT, a narzędziem ich obserwacji wgląd w zachowanie wbudowanego w nie systemu operacyjnego.

Podjęcie tematu bezpieczeństwa urządzeń internetu rzeczy było celem projektu „Budowa narzędzia dedykowanego dla ochrony użytkowników, systemów i urządzeń internetu rzeczy w oparciu o uczenie maszynowe i analizę behawioralną”, realizowanego w latach 2021-2024 przez Sieć Badawczą Łukasiewicz – Instytut Technik Innowacyjnych EMAG jako lidera konsorcjum oraz dwie firmy specjalizujące się w tematyce cyberbezpieczeństwa: Efigo sp. z o.o. oraz QED sp. z o.o. Ochrona urządzeń IoT oraz ich użytkowników wymaga wzięcia pod uwagę wielu aspektów. Istotnym czynnikiem wpływającym na poziom bezpieczeństwa cyberprzestrzeni jest nieustanna zmienność występująca w systemach typu IoT oraz nowo odkrywane podatności. Nieustannie pojawiają się nowe urządzenia, a aktualizacje oprogramowania w dotychczasowych powodują, że powstają coraz to nowe typy zdarzeń w logach systemowych tych urządzeń. To powoduje, że metody sztucznej inteligencji muszą być zdolne do szybkiej adaptacji. Muszą szybko wykrywać nowe rodzaje ataków oraz dostosowywać się do nowych danych.

Jednym z wyzwań tego przedsięwzięcia było stworzenie Agenta, oprogramowania monitorującego procesy działające na urządzeniu. Dane zebrane bezpośrednio przez Agenta nie nadają się do bezpośredniego zastosowania w modelach uczenia maszynowego, zatem konieczne było wypracowanie różnych metod przetwarzania tych danych (przykładowe zmienne niezależne i wolumen napływających danych pokazano na rysunku). Ponadto powstało również sprzętowe środowisko symulacyjne, które pozwoliło nam na przygotowanie różnych scenariuszy ataków i wytworzenie zbiorów danych z odpowiednimi etykietami.

Centralnym punktem systemu jest serwer wyposażony w algorytmy analizy behawioralnej oraz uczenia maszynowego, który na bieżąco ocenia dane napływające z urządzeń i przypisuje odpowiednim procesom oznaczenie anomalii bądź zagrożenia. Użytkownicy naszego systemu mają także graficzny dostęp do interfejsu w postaci SOC (Security Operations Center). Ekspercka ocena podatności prowadzona w SOC umożliwi bardziej efektywne wykorzystanie informacji w algorytmach uczenia maszynowego. Cykliczna ocena napływających zagrożeń pozwala dostrajać algorytmy uczenia maszynowego oraz poddawać weryfikacji istniejące zagrożenia i anomalie. Wypracowaliśmy także zestaw mechanizmów, które pozwalają przykładowo zablokować komunikację danego urządzenia IoT z niebezpiecznym adresem IP. Aktualne informacje na temat projektu znajdują się na stronie https://spinet.tech/.

W ramach projektu SPINET oraz przy okazji organizacji konferencji FedCSIS 2023 przeprowadzono ogólnoświatowy konkurs na platformie knowledgepit.ml. W ramach środowiska symulacyjnego wygenerowano realne zbiory danych zawierające jednominutowe logi wywołań systemowych. Zadaniem uczestników konkursu było opracowanie modelu, który oceni szanse na to, że w monitorowanym okresie trwał cyberatak. Wyniki konkursu pokazują, że dane o elementarnych procesach w urządzeniu IoT umożliwiają budowanie efektywnych modeli uczenia maszynowego do wykrywania zagrożeń. Większość rozwiązań zgłoszonych przez zespoły była zgodna z ogólnym schematem: przetwarzania/oczyszczania danych → wykonywania inżynierii cech → wyboru cech → budowy modelu. Istniały jednak pewne różnice w podejściu ze względu na hierarchiczną i skomplikowaną formę zebranych danych. Dane o procesach systemowych można agregować na wiele różnych sposobów. Etap ekstrakcji/inżynierii cech również był różnie traktowany przez uczestników. Łączna liczba skonstruowanych cech wahała się od kilku do kilkuset tysięcy. Najpopularniejsze modele uczenia maszynowego stosowane wśród uczestników konkursu należą do kategorii boostingu gradientowego – z konkretnymi implementacjami dostarczanymi przez powszechnie używane biblioteki open-source, takie jak XGBoost, LightGBM i CatBoost. Można było jednak napotkać również kilka innych modeli, w tym klasyczne, takie jak drzewa decyzyjne, losowy las, kNN i regresja logistyczna, a także niestandardowe metody. W rezultacie udawało się z prawie stuprocentową skutecznością wykrywać pojawiające się w danych anomalie.

W systemie stworzonym w ramach projektu SPINET wykorzystano doświadczenia zespołu projektowego oraz te zebrane w ramach omawianego konkursu do stworzenia dwóch reprezentacji danych, na których wykrywane są zagrożenia. Dodatkowo nasze rozwiązanie bazuje nie tylko na jednym modelu, lecz na zespole odpowiednio dobranych metod uczenia nadzorowanego i nienadzorowanego.

Ochrona przed zagrożeniami sieciowymi staje się w ostatnich latach jednym z kluczowych wyzwań w polskiej nauce. Rosnąca liczba urządzeń podłączonych do sieci internetowej oraz kreatywność cyberprzestępców sprawiają, że badania prowadzone w tym obszarze są koniecznością. Instytut Łukasiewicz – EMAG prowadzi szereg prac w obszarze cyberbezpieczeństwa w ramach m.in. Centrum Usług Bezpieczeństwa (CUBE) oraz Laboratorium ITSEF (IT Security Evaluation Facility).

Pomimo znaczącego rozwoju metod sztucznej inteligencji, wciąż wiele tematów wymaga dalszego rozpoznania. Na kanwie naszych projektowych doświadczeń wskażę tutaj kilka z nich. Pierwszy dotyczy dostosowania się do AI Act, czyli europejskiej regulacji mającej na celu uregulowanie użycia sztucznej inteligencji w Unii Europejskiej, wprowadzającej standardy bezpieczeństwa, przejrzystości i odpowiedzialności. Akt ten kategoryzuje systemy AI według ryzyka, od niskiego do wysokiego, nakładając surowsze wymagania na bardziej ryzykowne zastosowania, co ma na celu ochronę użytkowników i zapobieganie szkodom. Kolejna kwestia wymagająca rozpoznania to szybkość działania systemu ochrony, w przypadku ataku ransomware szyfrującego dane na urządzeniu czas wykrycia go jest kluczowy i standardowe techniki uczenia maszynowego oparte na języku python mogą w takiej sytuacji okazać się zbyt wolne. Infrastruktura urządzeń IoT zwykle jest architekturą rozproszoną i wymaga przesyłania danych do centralnego serwera w celu detekcji anomalii. W tym kontekście obiecującym kierunkiem rozwoju wydaje się uczenie federacyjne, które umożliwia zdecentralizowane przetwarzanie danych i trenowanie modeli na wielu urządzeniach. Takie podejście zwiększa prywatność i umożliwia dostosowanie środków bezpieczeństwa do konkretnych potrzeb bez centralizacji wrażliwych danych.

Dr Łukasz Wawrowski, Sieć Badawcza Łukasiewicz – Instytut Technik Innowacyjnych EMAG