Zbigniew Osiński

Niedawno ogłoszone wyniki ewaluacji dyscyplin naukowych wywołały szereg kontrowersji. Można było się tego spodziewać, zważywszy choćby na wcześniejsze negatywne głosy dotyczące szczegółowych zasad reformy nauki.

Skutki reformy nie dla wszystkich okazały się pozytywne, co niewątpliwe wzmocniło krytycyzm zarówno tych, którzy od dawna krytykują poszczególne aspekty reformy, jak i tych, którzy dopiero teraz dostrzegli jej wady. Między innymi okazało się, że system ewaluacji nauki oparty na punktacji czasopism, ściśle związanej ze wskaźnikami cytowalności (IF, SNIP), stworzył duże problemy w naukach humanistycznych i społecznych. Praktyka pokazała, że publikowanie artykułów w większości polskich czasopism nie przyniesie punktów w liczbie wystarczającej na potrzeby oceny (i uzyskania kategorii innej niż B lub C). Stąd też różnorodne „ratownicze” zabiegi ministra nauki Przemysława Czarnka oraz ekipy wdrażającej reformę. System okazał się więc podatny na manipulacje danymi ewaluacyjnymi. Efektem są coraz bardziej słyszalne głosy wskazujące na woluntaryzm w punktacji czasopism i sugerujące, że jest on źródłem wypaczeń w procesie przyznawania kategorii naukowych (oko.press, wywiad w Emanuelem Kulczyckim, „Ewaluacja nauki to porażka”).

W tym momencie, jako „odwieczny” przeciwnik wykorzystywania wskaźników bibliometrycznych do ferowania ocen w nauce, mógłbym wzruszyć ramionami i przywołać frazę „widział gały, co brały”. Widziały, że bazy Scopus i Web of Science indeksują jedynie kilkanaście procent czasopism z nauk humanistycznych i społecznych, deprecjonując przy tym te, które nie są wydawane w języku angielskim przez wielkie koncerny wydawnicze. Widziały, że wskaźniki typu Impact Factor i SNIP wskazują na cytowalność (jakoby tożsamą z wpływem na rozwój nauki) czasopism, a nie artykułów. Stad też sugerowanie, że każdy artykuł opublikowany w czasopiśmie zdobywającym stosunkowo dużo cytowań wywiera istotny wpływ na rozwój nauki i zasługuje na stosunkowo dużą liczbę punktów parametryzacyjnych, nie jest zasadne. Widziały, że do obliczania każdego z wymienionych wskaźników przyjmuje się cytowania jedynie z okresu kilku lat, a nie wszystkie, że pomija się cytowania zdobyte w czasopismach i książkach, które nie zostały zindeksowane w rzeczonych bazach itp., itd.

Jednakże w niniejszym artykule nie chciałbym ograniczyć się do tego, co jest powszechnie (w środowisku naukowym) znane i z satysfakcją zauważyć: a nie mówiłem?. Chciałbym bowiem wskazać na inny problem z danymi o cytowaniach (i nie tylko), który w powiazaniu z zarzutami o rasizm, stawianymi jakoby obiektywnym algorytmom przetwarzania danych (ithardware.pl, P. Czajkowski, „Predykcyjne algorytmy AI opieki społecznej oskarżane są o rasizm, https://www.dw.com/pl/rasizm-na-ekranie-kontrowersyjne-algorytmy-twittera/a-55089428), powinien skłaniać do ostrożności w ich wykorzystywaniu, zwłaszcza tych, które pochodzą z niezbyt kompletnych baz. Problem ten w nielicznej jeszcze literaturze naukowej określa się mianem „takie same dane – różne rezultaty” (researchgate.net, J. Glaser, W. Glanzel, A. Scharnhorst, Same data -different results? Towards a comparative approach to the identification of thematic structures in science”). Dostrzegłem ten problem, badając dane bibliograficzne oraz dane o liczbie i źródłach cytowań pochodzące z baz Scopus i Web of Science z wykorzystaniem różnych metod analizy.

Algorytmy stosowane przez redakcje obu baz, służące do przydzielania czasopismom wskaźników wpływu (IF, SNIP), opierają się na zliczaniu cytowań zdobytych przez artykuły opublikowane w danym czasopiśmie. Uwzględniane są cytowania z kilku ostatnich lat pochodzące ze źródeł indeksowanych w danej bazie. Nie bierze się pod uwagę, czy cokolwiek łączy artykuł cytowany z cytującym – np. tematyka, dyscyplina naukowa, źródło publikacji itp. Należy podkreślić, że takie powiazania świadczą o istnieniu silniejszego niż same cytowania związku pomiędzy publikacjami. Przykładem może być współcytowanie: jeśli publikacje A i B są cytowane przez C, można powiedzieć, że istnieją pomiędzy nimi powiazania, nawet jeśli cytowania nie odnoszą się bezpośrednio do siebie. Podobnie, jeżeli A i B cytują te same publikacje (C, D, E), to istnieje pomiędzy nimi widoczny związek tematyczny. W ten sposób algorytmy programów do analizy danych bibliograficznych (np. CiteSpace) łączą dokumenty cytujące i cytowane w jednym klastrze (grupa podobnych tematycznie publikacji). Kolejnym przykładem może być siła (intensywność) relacji współwystępowania specjalistycznych terminów kluczowych. Dlaczego nie uznać, że cytowania zdobyte przez daną publikację w dokumentach należących do tej samej sieci współcytowań (klaster) lub opatrzonych podobnym zestawem słów kluczowych, mają większą wartość niż cytowania pochodzące z publikacji nie mających widocznego związku tematycznego z pracą cytowaną? Bo jest to bardziej skomplikowane niż metoda stosowana przez wspomniane bazy bibliograficzne? A może nie ma o co kruszyć kopii, bowiem niezależnie od metody wynik (wykrycie najbardziej wpływowych czasopism, autorów i publikacji, przydzielenie IF lub SNIP) będzie bardzo podobny?

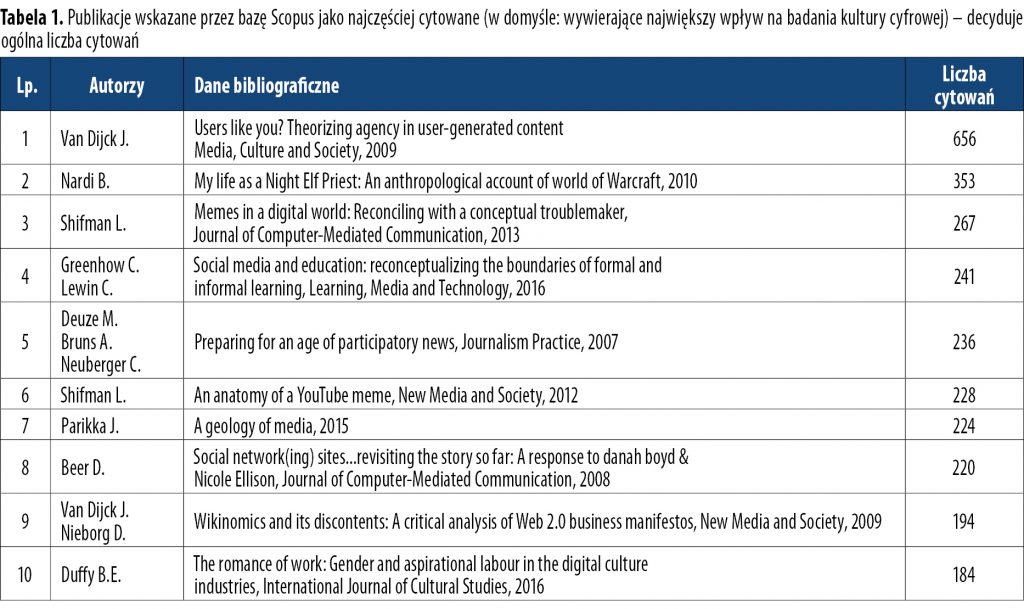

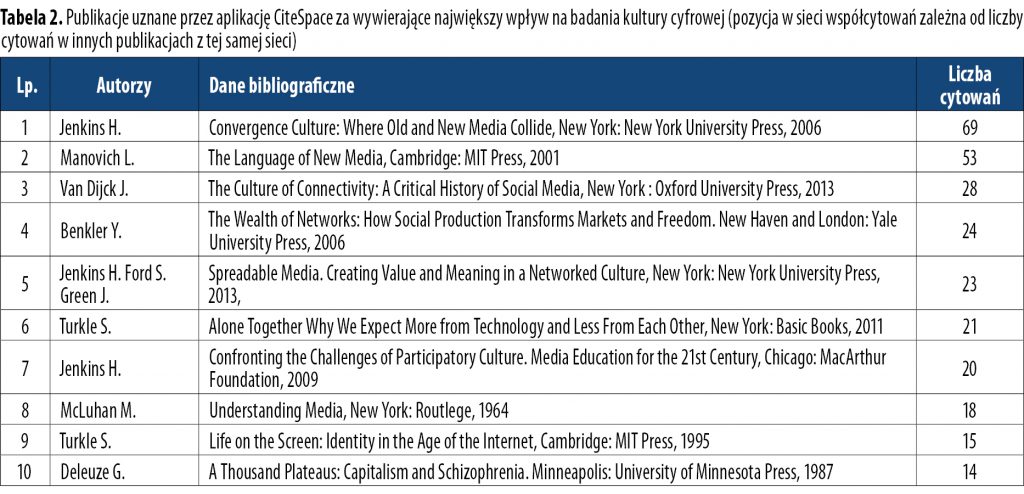

Odpowiedź na ostatnie pytanie możliwa jest dzięki prostemu badaniu. Z bazy Scopus pobrałem dane bibliograficzne oraz o cytowaniach publikacji związanych z terminem Digital Culture. Następnie wykorzystałem te dane do przeprowadzeni dwóch analiz mających odpowiedzieć na pytanie, które publikacje wywarły największy wpływ na badania kultury cyfrowej? Pierwsza analiza sprowadzała się do wykorzystania funkcjonalności bazy Scopus. Uzyskałem listę publikacji najczęściej cytowanych w innych źródłach indeksowanych w tej bazie. Do drugiej analizy wykorzystałem program CiteSpace. Aplikacja ta służy do wizualizacji i analizy danych bibliograficznych pobranych z niektórych naukowych baz danych. Na podstawie danych bibliograficznych poszczególnych tekstów naukowych oraz listy cytowań użytych w tych tekstach CiteSpace generuje wizualizacje sieci powiązań (m.in. współcytowaniami) i klastry tematyczne, z których można odczytać różnorodne trendy, prawidłowości i wzorce. Porównanie wyników obu analiz jest bardzo ciekawe.

Jeżeli porównamy obie listy publikacji, to zauważymy nie tylko fakt, iż są w 100% różne (rozszerzenie obu list nawet do pierwszych stu publikacji zmienia obraz sytuacji jedynie w niewielkim stopniu). Istotne jest także to, że według algorytmów bazy Scopus największy wpływ na badania kultury cyfrowej wywierają artykuły w czasopismach, a według algorytmów CiteSpace publikacje książkowe. Obie listy powstały na bazie tych samych danych bibliograficznych. Różne były metody analizy i podejście do znaczenia danych. Scopus premiuje ogólną liczbę cytowań, a CiteSpace cytowania w sieci współcytowań, w ramach klastra tematycznego. Wybór metody analizy danych sprowadza się w tym przypadku do rozstrzygnięcia dylematu: czy publikacja wywiera wpływ ogólnie na rozwój nauki (wszelkich dyscyplin), czy na rozwój określonej tematyki badawczej? W związku z tym pojawia się kolejne pytanie: które czasopisma/książki powinny być wyżej punktowane – te, które uzyskują ogólnie dużo cytowań, czy te, które uzyskują dużo cytowań w klastrach tematycznych? Przecież każde czasopismo/książka może wywierać różny wpływ na każdą z dyscyplin/specjalności naukowych, którą reprezentuje. Dlaczego właściwe miałoby być stosowanie wskaźników uśredniających te wpływy? Bo jest to łatwiejsze? Ale czy pozwalające na obiektywizację ocen? Pierwszy system nie sprawdził się w praktyce, a drugi jest bardzo skomplikowany i pracochłonny (każde czasopismo powinno mieć wyliczonych tyle współczynników wpływu, ile obszarów tematycznych reprezentuje).

Aby jeszcze bardziej skomplikować omawiany problem, należy wspomnieć o artykule, którego autorami są Aleksandra Mrela, Veslava Osińska i Oleksandr Sokolov, a który ukazał się na łamach czasopisma „Bulletin of the Polish Academy of Sciences, Technical Sciences” (https://journals.pan.pl/dlibra/publication/141988/edition/123960/content). Zaprezentowano w nim nową koncepcję analizy danych bibliograficznych (w tym cytowania), której celem byłoby obliczanie wpływu publikacji na rozwój wiedzy. Autorzy zaproponowali, aby oszacowania wkładu w rozwój wiedzy dokonywano, biorąc pod uwagę nie tylko bezpośrednią liczbę cytowań poszczególnych tekstów, lecz także pośrednie dziedziczenie cytowań między artykułami cytowanymi a cytującymi w ramach sieci cytowani (wartość publikacji zależna nie tylko od cytowań, które zdobyła, lecz także od cytowań, które zdobyły publikacje cytujące). Nie wątpię, że także i ta metoda analizy danych bibliograficznych da inne rezultaty, w sensie wskazania na publikacje o istotnym dla nauki znaczeniu, niż sugerują to wskaźniki baz Scopus i Web o Science. Przypomnieć jeszcze wypada, że dla wielu dyscyplin humanistycznych i społecznych zasoby obu baz są wyjątkowo niekompletne, co podważa „naukowość” wszelkich analiz dokonywanych na podstawie danych z nich pochodzących. Może więc pora zrezygnować z prób „ujarzmienia” danych bibliograficznych (w tym cytowań), a system ewaluacji nauki oprzeć na innych, bardziej jednoznacznych i obiektywnych z punktu widzenia metodologii nauk, podstawach. Pamiętajmy bowiem, że te same dane nie zawsze dają takie same wyniki analiz, a algorytmy przetwarzania danych bywają wysoce zawodne.

Zbigniew Osiński, UMCS w Lublinie